导言

Go 基于 I/O multiplexing 和 goroutine scheduler 构建了一个简洁而高性能的原生网络模型(基于 Go 的 I/O 多路复用 netpoller ),提供了 goroutine-per-connection 这样简单的网络编程模式。在这种模式下,开发者使用的是同步的模式去编写异步的逻辑,极大地降低了开发者编写网络应用时的心智负担,且借助于 Go runtime scheduler 对 goroutines 的高效调度,这个原生网络模型不论从适用性还是性能上都足以满足绝大部分的应用场景。

然而,在工程性上能做到如此高的普适性和兼容性,最终暴露给开发者提供接口/模式如此简洁,其底层必然是基于非常复杂的封装,做了很多取舍,也有可能放弃了一些追求极致性能的设计和理念。事实上 Go netpoller 底层就是基于 epoll/kqueue/iocp 这些 I/O 多路复用技术来做封装的,最终暴露出 goroutine-per-connection 这样的极简的开发模式给使用者。

Go netpoller 在不同的操作系统,其底层使用的 I/O 多路复用技术也不一样,可以从 Go 源码目录结构和对应代码文件了解 Go 在不同平台下的网络 I/O 模式的实现。比如,在 Linux 系统下基于 epoll,freeBSD 系统下基于 kqueue,以及 Windows 系统下基于 iocp。

本文将基于 Linux 平台来解析 Go netpoller 之 I/O 多路复用的底层是如何基于 epoll 封装实现的,从源码层层推进,全面而深度地解析 Go netpoller 的设计理念和实现原理,以及 Go 是如何利用 netpoller 来构建它的原生网络模型的。

Go runtime已经实现了netpoller,这使得即便G发起网络I/O操作也不会导致M被阻塞(仅阻塞G),从而不会导致大量M被创建出来。但是对于regular file的I/O操作一旦阻塞,那么M将进入sleep状态,等待I/O返回后被唤醒;这种情况下P将与sleep的M分离,再选择一个idle的M。如果此时没有idle的M,则会新创建一个M,这就是为何大量I/O操作导致大量Thread被创建的原因。

Ian Lance Taylor在Go 1.9 dev周期中增加了一个Poller for os package的功能,这个功能可以像netpoller那样,在G操作支持pollable的fd时,仅阻塞G,而不阻塞M。不过该功能依然不能对regular file有效,regular file不是pollable的。不过,对于scheduler而言,这也算是一个进步了。

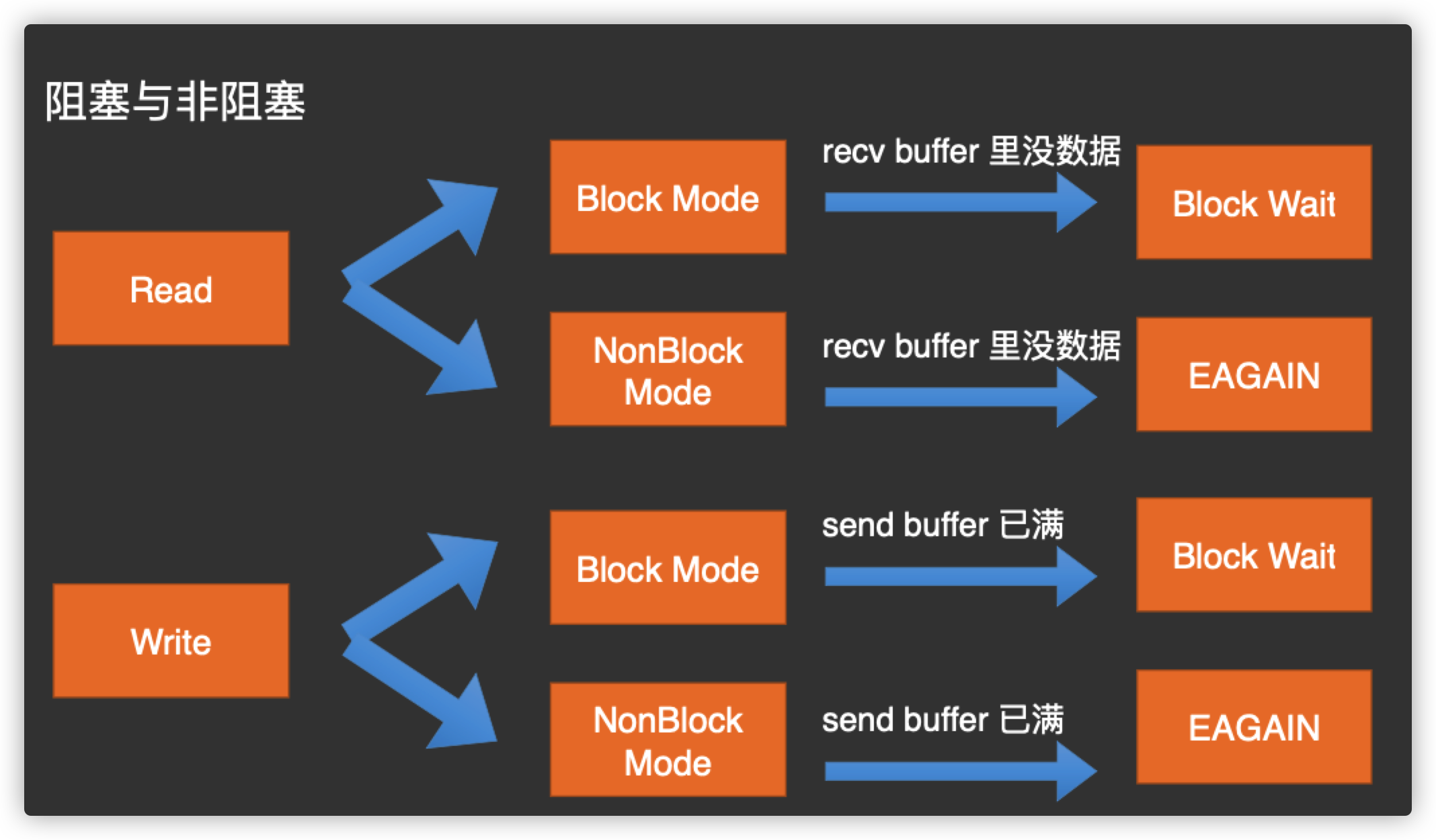

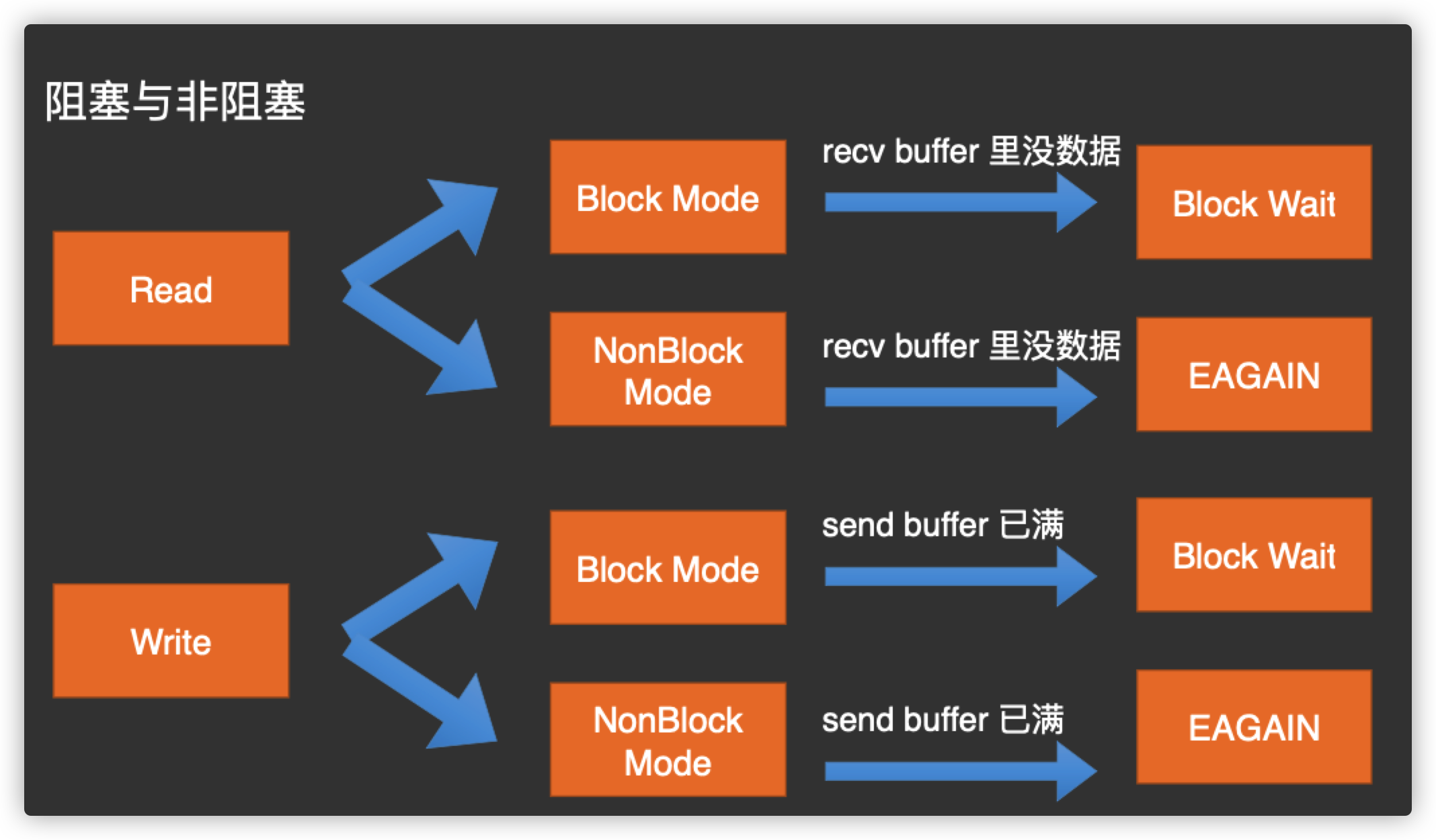

阻塞与非阻塞

基本原理

Go netpoller 通过在底层对 epoll/kqueue/iocp 的封装,从而实现了使用同步编程模式达到异步执行的效果。总结来说,所有的网络操作都以网络描述符 netFD 为中心实现。netFD 与底层 PollDesc 结构绑定,当在一个 netFD 上读写遇到 EAGAIN 错误时,就将当前 goroutine 存储到这个 netFD 对应的 PollDesc 中,同时调用 gopark 把当前 goroutine 给 park 住,直到这个 netFD 上再次发生读写事件,才将此 goroutine 给 ready 激活重新运行。显然,在底层通知 goroutine 再次发生读写等事件的方式就是 epoll/kqueue/iocp 等事件驱动机制。

总所周知,Go 是一门跨平台的编程语言,而不同平台针对特定的功能有不用的实现,这当然也包括了 I/O 多路复用技术,比如 Linux 里的 I/O 多路复用有 select、poll 和 epoll,而 freeBSD 或者 MacOS 里则是 kqueue,而 Windows 里则是基于异步 I/O 实现的 iocp,等等;因此,Go 为了实现底层 I/O 多路复用的跨平台,分别基于上述的这些不同平台的系统调用实现了多版本的 netpollers,具体的源码路径如下:

1

2

3

4

5

6

|

src/runtime/netpoll_epoll.go

src/runtime/netpoll_kqueue.go

src/runtime/netpoll_solaris.go

src/runtime/netpoll_windows.go

src/runtime/netpoll_aix.go

src/runtime/netpoll_fake.go

|

本文的解析基于 epoll 版本,如果读者对其他平台的 netpoller 底层实现感兴趣,可以在阅读完本文后自行翻阅其他 netpoller 源码,所有实现版本的机制和原理基本类似,所以了解了 epoll 版本的实现后再去学习其他版本实现应该没什么障碍。

epoll、kqueue、solaries 等多路复用模块都要实现以下五个函数,这五个函数构成一个虚拟的接口:

1

2

3

4

5

|

func netpollinit()

func netpollopen(fd uintptr, pd *pollDesc) int32

func netpoll(delta int64) gList

func netpollBreak()

func netpollIsPollDescriptor(fd uintptr) bool

|

上述函数在网络轮询器中分别扮演了不同的作用:

- runtime.netpollinit — 初始化网络轮询器,通过 sync.Once 和 netpollInited 变量保证函数只会调用一次;

- runtime.netpollopen — 监听文件描述符上的边缘触发事件,创建事件并加入监听;

- runtime.netpoll — 轮询网络并返回一组已经准备就绪的 Goroutine,传入的参数会决定它的行为;

- 如果参数小于 0,无限期等待文件描述符就绪;

- 如果参数等于 0,非阻塞地轮询网络;

- 如果参数大于 0,阻塞特定时间轮询网络;

- runtime.netpollBreak — 唤醒网络轮询器,例如:计时器向前修改时间时会通过该函数中断网络轮询器;

- runtime.netpollIsPollDescriptor — 判断文件描述符是否被轮询器使用;

接下来让我们全面剖析一下整个 Go netpoller 的运行机制和流程。

pollDesc

操作系统中 I/O 多路复用函数会监控文件描述符的可读或者可写,而 Go 语言网络轮询器会监听 runtime.pollDesc 结构体的状态,该结构会封装操作系统的文件描述符:

前面提到了 pollDesc 是底层事件驱动的封装,netFD 通过它来完成各种 I/O 相关的操作,它的定义如下:

1

2

3

|

type pollDesc struct {

runtimeCtx uintptr

}

|

这里的 struct 只包含了一个指针,而通过 pollDesc 的 init 方法,我们可以找到它具体的定义是在 runtime.pollDesc 这里:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

|

// Network poller descriptor.

//

// No heap pointers.

//

//go:notinheap

type pollDesc struct {

link *pollDesc // in pollcache, protected by pollcache.lock

// The lock protects pollOpen, pollSetDeadline, pollUnblock and deadlineimpl operations.

// This fully covers seq, rt and wt variables. fd is constant throughout the PollDesc lifetime.

// pollReset, pollWait, pollWaitCanceled and runtime·netpollready (IO readiness notification)

// proceed w/o taking the lock. So closing, everr, rg, rd, wg and wd are manipulated

// in a lock-free way by all operations.

// NOTE(dvyukov): the following code uses uintptr to store *g (rg/wg),

// that will blow up when GC starts moving objects.

lock mutex // protects the following fields

fd uintptr

closing bool

everr bool // marks event scanning error happened

user uint32 // user settable cookie

rseq uintptr // protects from stale read timers

rg uintptr // pdReady, pdWait, G waiting for read or nil

rt timer // read deadline timer (set if rt.f != nil)

rd int64 // read deadline

wseq uintptr // protects from stale write timers

wg uintptr // pdReady, pdWait, G waiting for write or nil

wt timer // write deadline timer

wd int64 // write deadline

}

|

该结构体中包含用于监控可读和可写状态的变量,我们按照功能将它们分成以下四组:

- rseq 和 wseq — 表示文件描述符被重用或者计时器被重置5;

- rg 和 wg — 表示二进制的信号量,可能为 pdReady、pdWait、等待文件描述符可读或者可写的 Goroutine 以及 nil;它们是实现唤醒 goroutine 的关键。

- rd 和 wd — 等待文件描述符可读或者可写的截止日期;

- rt 和 wt — 用于等待文件描述符的计时器;

pollCache

runtime.pollDesc 包含自身类型的一个指针,用来保存下一个 runtime.pollDesc 的地址,以此来实现链表,可以减少数据结构的大小,所有的 runtime.pollDesc 保存在 runtime.pollCache 结构中,定义如下:

1

2

3

4

5

6

7

8

9

|

type pollCache struct {

lock mutex

first *pollDesc

// PollDesc objects must be type-stable,

// because we can get ready notification from epoll/kqueue

// after the descriptor is closed/reused.

// Stale notifications are detected using seq variable,

// seq is incremented when deadlines are changed or descriptor is reused.

}

|

因为 runtime.pollCache 是一个在 runtime 包里的全局变量,因此需要用一个互斥锁来避免 data race 问题,从它的名字也能看出这是一个用于缓存的数据结构,也就是用来提高性能的,具体如何实现呢?

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

|

const pollBlockSize = 4 *1024

func (c *pollCache) alloc() *pollDesc {

lock(&c.lock)

if c.first == nil {

const pdSize = unsafe.Sizeof(pollDesc{})

n := pollBlockSize / pdSize

if n == 0 {

n = 1

}

// Must be in non-GC memory because can be referenced

// only from epoll/kqueue internals.

mem := persistentalloc(n*pdSize, 0, &memstats.other_sys)

for i := uintptr(0); i < n; i++ {

pd := (*pollDesc)(add(mem, i*pdSize))

pd.link = c.first

c.first = pd

}

}

pd := c.first

c.first = pd.link

lockInit(&pd.lock, lockRankPollDesc)

unlock(&c.lock)

return pd

}

|

Go runtime 会在调用 poll_runtime_pollOpen 往 epoll 实例注册 fd 之时首次调用 runtime.pollCache.alloc方法时批量初始化大小 4KB 的 runtime.pollDesc 结构体的链表,初始化过程中会调用 runtime.persistentalloc 来为这些数据结构分配不会被 GC 回收的内存,确保这些数据结构只能被 epoll和kqueue 在内核空间去引用。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

|

// Wrapper around sysAlloc that can allocate small chunks.

// There is no associated free operation.

// Intended for things like function/type/debug-related persistent data.

// If align is 0, uses default align (currently 8).

// The returned memory will be zeroed.

//

// Consider marking persistentalloc'd types go:notinheap.

func persistentalloc(size, align uintptr, sysStat *sysMemStat) unsafe.Pointer {

var p *notInHeap

systemstack(func() {

p = persistentalloc1(size, align, sysStat)

})

return unsafe.Pointer(p)

}

// Must run on system stack because stack growth can (re)invoke it.

// See issue 9174.

//go:systemstack

func persistentalloc1(size, align uintptr, sysStat *sysMemStat) *notInHeap {

const (

maxBlock = 64 << 10 // VM reservation granularity is 64K on windows

)

if size == 0 {

throw("persistentalloc: size == 0")

}

if align != 0 {

if align&(align-1) != 0 {

throw("persistentalloc: align is not a power of 2")

}

if align > _PageSize {

throw("persistentalloc: align is too large")

}

} else {

align = 8

}

if size >= maxBlock {

return (*notInHeap)(sysAlloc(size, sysStat))

}

mp := acquirem()

var persistent *persistentAlloc

if mp != nil && mp.p != 0 {

persistent = &mp.p.ptr().palloc

} else {

lock(&globalAlloc.mutex)

persistent = &globalAlloc.persistentAlloc

}

persistent.off = alignUp(persistent.off, align)

if persistent.off+size > persistentChunkSize || persistent.base == nil {

persistent.base = (*notInHeap)(sysAlloc(persistentChunkSize, &memstats.other_sys))

if persistent.base == nil {

if persistent == &globalAlloc.persistentAlloc {

unlock(&globalAlloc.mutex)

}

throw("runtime: cannot allocate memory")

}

// Add the new chunk to the persistentChunks list.

for {

chunks := uintptr(unsafe.Pointer(persistentChunks))

*(*uintptr)(unsafe.Pointer(persistent.base)) = chunks

if atomic.Casuintptr((*uintptr)(unsafe.Pointer(&persistentChunks)), chunks, uintptr(unsafe.Pointer(persistent.base))) {

break

}

}

persistent.off = alignUp(sys.PtrSize, align)

}

p := persistent.base.add(persistent.off)

persistent.off += size

releasem(mp)

if persistent == &globalAlloc.persistentAlloc {

unlock(&globalAlloc.mutex)

}

if sysStat != &memstats.other_sys {

sysStat.add(int64(size))

memstats.other_sys.add(-int64(size))

}

return p

}

|

再往后每次调用这个方法则会先判断链表头是否已经分配过值了,若是,则直接返回表头这个 pollDesc,这种批量初始化数据进行缓存而后每次都直接从缓存取数据的方式是一种很常见的性能优化手段,在这里这种方式可以有效地提升 netpoller 的吞吐量。

Go runtime 会在关闭 pollDesc 之时调用 runtime.pollCache.free 释放内存,它会直接将结构体插入链表的最前面:

1

2

3

4

5

6

|

func (c *pollCache) free(pd *pollDesc) {

lock(&c.lock)

pd.link = c.first

c.first = pd

unlock(&c.lock)

}

|

上述方法没有重置 runtime.pollDesc 结构体中的字段,该结构体被重复利用时才会由 runtime.poll_runtime_pollOpen 函数重置。

运行机制

网络轮询器实际上就是对 I/O 多路复用技术的封装,本节将通过以下的三个过程分析网络轮询器的实现原理:

- 网络轮询器的初始化;

- 如何向网络轮询器中加入待监控的任务;

- 如何从网络轮询器中获取触发的事件;

上述三个过程包含了网络轮询器相关的方方面面,能够让我们对其实现有完整的理解。需要注意的是,我们在分析实现时会遵循以下两个规则:

- 因为不同 I/O 多路复用模块的实现大同小异,本节会使用 Linux 操作系统上的 epoll 实现;

- 因为处理读事件和写事件的逻辑类似,本节会省略写事件相关的代码;

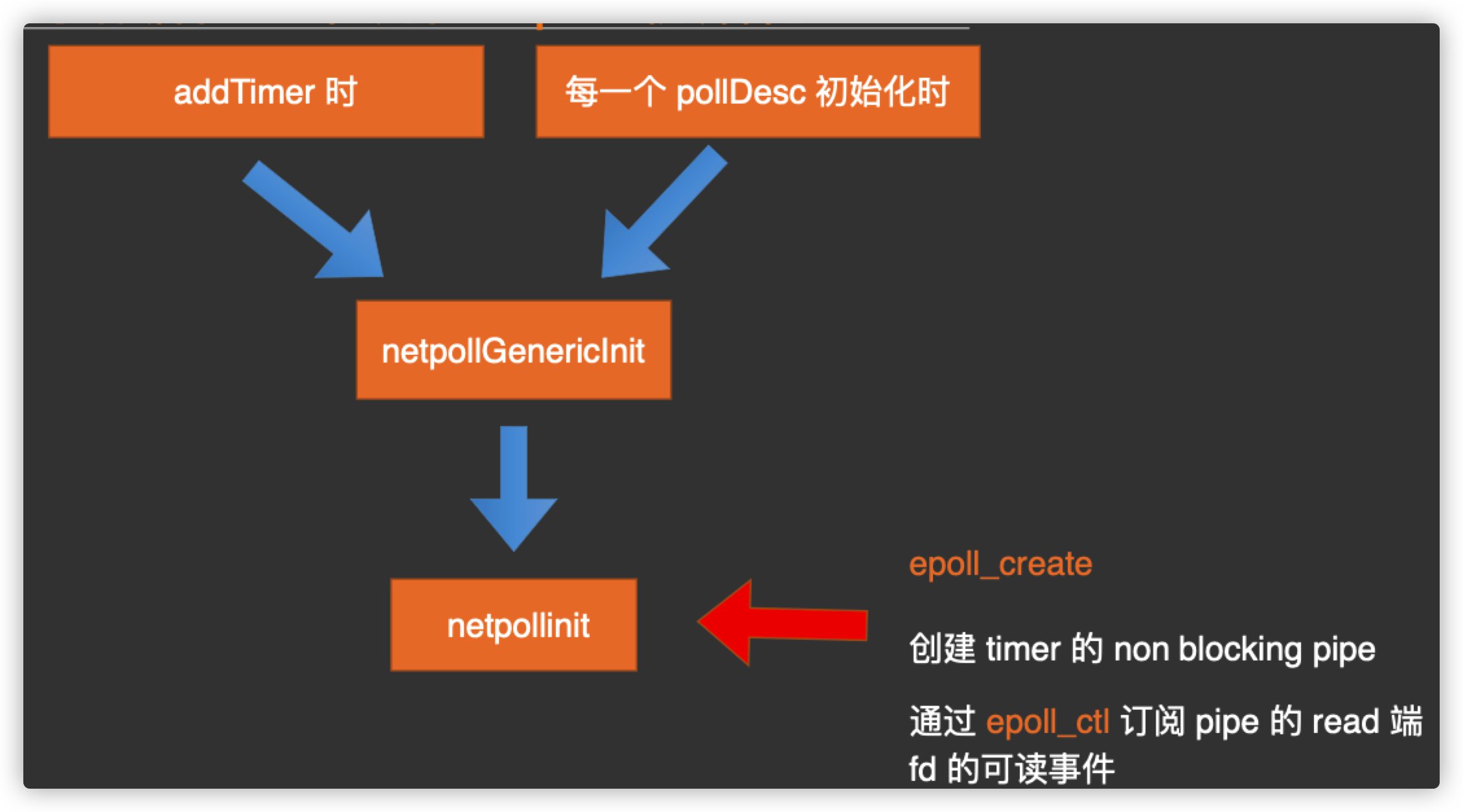

初始化

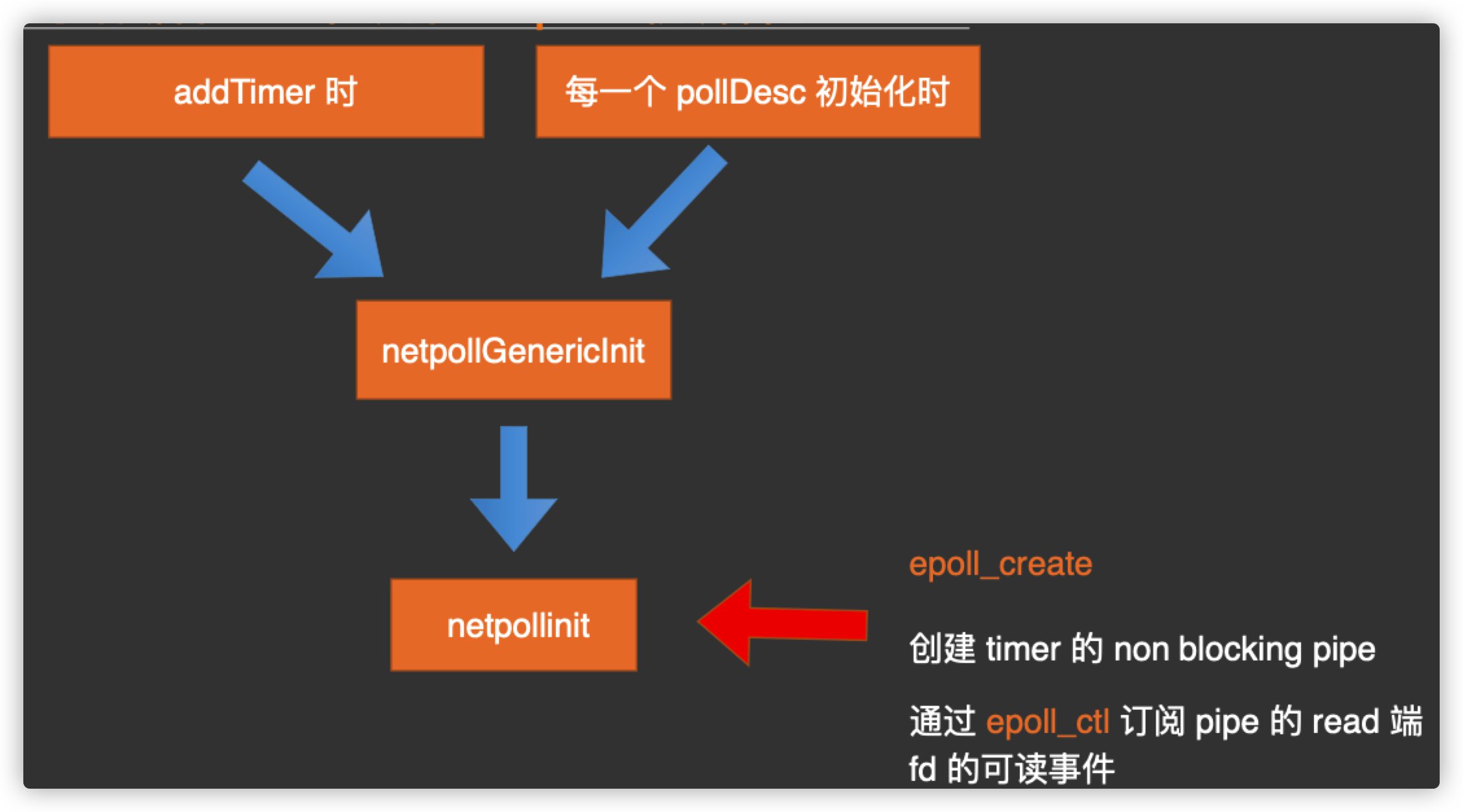

因为文件 I/O、网络 I/O 以及计时器都依赖网络轮询器,所以 Go 语言会通过以下两条不同路径初始化网络轮询器:

- internal/poll.pollDesc.init — 通过 net.netFD.init 和 os.newFile 初始化网络 I/O 和文件 I/O 的轮询信息时;

- runtime.doaddtimer — 向处理器中增加新的计时器时;

网络轮询器的初始化会使用 runtime.poll_runtime_pollServerInit 和 runtime.netpollGenericInit 两个函数:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

|

func runtime_pollServerInit()

func poll_runtime_pollServerInit() {

netpollGenericInit()

}

func netpollGenericInit() {

if atomic.Load(&netpollInited) == 0 {

lock(&netpollInitLock)

if netpollInited == 0 {

netpollinit()

atomic.Store(&netpollInited, 1)

}

unlock(&netpollInitLock)

}

}

|

runtime.netpollGenericInit 会调用平台上特定实现的 runtime.netpollinit 函数,即 Linux 上的 epoll,它主要做了以下几件事情:

- 调用 epollcreate1 创建一个新的 epoll 文件描述符,这个文件描述符会在整个程序的生命周期中使用;

- 通过 runtime.nonblockingPipe 创建一个用于通信的管道;

- 使用 epollctl 将用于读取数据的文件描述符打包成 epollevent 事件加入监听;

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

|

var (

// 全局唯一的 epoll fd,只在 listener fd 初始化之时被指定一次

epfd int32 = -1 // epoll descriptor

)

// netpollinit 会创建一个 epoll 实例,然后把 epoll fd 赋值给 epfd,

// 后续 listener 以及它 accept 的所有 sockets 有关 epoll 的操作都是基于这个全局的 epfd

func netpollinit() {

epfd = epollcreate1(_EPOLL_CLOEXEC)

if epfd < 0 {

epfd = epollcreate(1024)

if epfd < 0 {

println("runtime: epollcreate failed with", -epfd)

throw("runtime: netpollinit failed")

}

closeonexec(epfd)

}

r, w, errno := nonblockingPipe()

if errno != 0 {

println("runtime: pipe failed with", -errno)

throw("runtime: pipe failed")

}

ev := epollevent{

events: _EPOLLIN,

}

*(**uintptr)(unsafe.Pointer(&ev.data)) = &netpollBreakRd

errno = epollctl(epfd, _EPOLL_CTL_ADD, r, &ev)

if errno != 0 {

println("runtime: epollctl failed with", -errno)

throw("runtime: epollctl failed")

}

netpollBreakRd = uintptr(r)

netpollBreakWr = uintptr(w)

}

func nonblockingPipe() (r, w int32, errno int32) {

r, w, errno = pipe()

if errno != 0 {

return -1, -1, errno

}

closeonexec(r)

setNonblock(r)

closeonexec(w)

setNonblock(w)

return r, w, errno

}

|

初始化的管道为我们提供了中断多路复用等待文件描述符中事件的方法,runtime.netpollBreak 函数会向管道中写入数据唤醒 epoll:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

|

func netpollBreak() {

for {

var b byte

n := write(netpollBreakWr, unsafe.Pointer(&b), 1)

if n == 1 {

break

}

if n == -_EINTR {

continue

}

if n == -_EAGAIN {

return

}

}

}

|

因为目前的计时器由网络轮询器管理和触发,它能够让网络轮询器立刻返回并让运行时检查是否有需要触发的计时器。

增删轮询事件

pollOpen

调用 internal/poll.pollDesc.init 初始化文件描述符时不只会初始化网络轮询器,还会通过 runtime.poll_runtime_pollOpen 函数重置轮询信息 runtime.pollDesc 并调用 runtime.netpollopen 初始化轮询事件:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

|

func runtime_pollOpen(fd uintptr) (uintptr, int)

func poll_runtime_pollOpen(fd uintptr) (*pollDesc, int) {

pd := pollcache.alloc()

lock(&pd.lock)

if pd.wg != 0 && pd.wg != pdReady {

throw("runtime: blocked write on free polldesc")

}

...

pd.fd = fd

pd.closing = false

pd.everr = false

...

pd.wseq++

pd.wg = 0

pd.wd = 0

unlock(&pd.lock)

var errno int32

errno = netpollopen(fd, pd)

return pd, int(errno)

}

|

runtime.netpollopen 的实现非常简单,它会调用 epollctl 向全局的轮询文件描述符 epfd 中加入新的轮询事件监听文件描述符的可读和可写状态:

1

2

3

4

5

6

7

8

9

|

// netpollopen 会被 runtime_pollOpen 调用,注册 fd 到 epoll 实例,

// 注意这里使用的是 epoll 的 ET 模式,同时会利用万能指针把 pollDesc 保存到 epollevent 的一个 8 位的字节数组 data 里

func netpollopen(fd uintptr, pd *pollDesc) int32 {

var ev epollevent

ev.events = _EPOLLIN | _EPOLLOUT | _EPOLLRDHUP | _EPOLLET

*(**pollDesc)(unsafe.Pointer(&ev.data)) = pd

return -epollctl(epfd, _EPOLL_CTL_ADD, int32(fd), &ev)

}

|

pollClose

从全局的 epfd 中删除待监听的文件描述符可以使用 runtime.netpollclose 函数,因为该函数的实现与 runtime.netpollopen 比较相似,所以这里就不展开分析了。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

|

//go:linkname poll_runtime_pollClose internal/poll.runtime_pollClose

func poll_runtime_pollClose(pd *pollDesc) {

if !pd.closing {

throw("runtime: close polldesc w/o unblock")

}

if pd.wg != 0 && pd.wg != pdReady {

throw("runtime: blocked write on closing polldesc")

}

if pd.rg != 0 && pd.rg != pdReady {

throw("runtime: blocked read on closing polldesc")

}

netpollclose(pd.fd)

pollcache.free(pd)

}

|

1

2

3

4

|

func netpollclose(fd uintptr) int32 {

var ev epollevent

return -epollctl(epfd, _EPOLL_CTL_DEL, int32(fd), &ev)

}

|

事件循环

本节将继续介绍网络轮询器的核心逻辑,也就是事件循环。我们将从以下的两个部分介绍事件循环的实现原理:

- Goroutine 让出线程并等待读写事件;

- 多路复用等待读写事件的发生并返回;

上述过程连接了操作系统中的 I/O 多路复用机制和 Go 语言的运行时,在两个不同体系之间构建了桥梁,我们将分别介绍上述的两个过程。

等待事件

当我们在文件描述符上执行读写操作时,如果文件描述符不可读或者不可写,当前 Goroutine 就会执行 runtime.poll_runtime_pollWait 检查 runtime.pollDesc 的状态并调用 runtime.netpollblock 等待文件描述符的可读或者可写

pollWait

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

|

//go:linkname poll_runtime_pollWait internal/poll.runtime_pollWait

func poll_runtime_pollWait(pd *pollDesc, mode int) int {

err := netpollcheckerr(pd, int32(mode))

if err != pollNoError {

return err

}

// As for now only Solaris, illumos, and AIX use level-triggered IO.

if GOOS == "solaris" || GOOS == "illumos" || GOOS == "aix" {

netpollarm(pd, mode)

}

// 进入 netpollblock 并且判断是否有期待的 I/O 事件发生,

// 这里的 for 循环是为了一直等到 io ready

for !netpollblock(pd, int32(mode), false) {

err = netpollcheckerr(pd, int32(mode))

if err != 0 {

return err

}

// Can happen if timeout has fired and unblocked us,

// but before we had a chance to run, timeout has been reset.

// Pretend it has not happened and retry.

}

return 0

}

|

netpollblock

runtime.netpollblock 是 Goroutine 等待 I/O 事件的关键函数,它会使用运行时提供的 runtime.gopark 让出当前线程,将 Goroutine 转换到休眠状态并等待运行时的唤醒。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

|

// returns true if IO is ready, or false if timedout or closed

// waitio - wait only for completed IO, ignore errors

func netpollblock(pd *pollDesc, mode int32, waitio bool) bool {

// gpp 保存的是 goroutine 的数据结构 g,这里会根据 mode 的值决定是 rg 还是 wg,

// 前面提到过,rg 和 wg 是用来保存等待 I/O 就绪的 gorouine 的,后面调用 gopark 之后,

// 会把当前的 goroutine 的抽象数据结构 g 存入 gpp 这个指针,也就是 rg 或者 wg

gpp := &pd.rg

if mode == 'w' {

gpp = &pd.wg

}

// set the gpp semaphore to WAIT

// 这个 for 循环是为了等待 io ready 或者 io wait

for {

old := *gpp

// gpp == pdReady 表示此时已有期待的 I/O 事件发生,

// 可以直接返回 unblock 当前 goroutine 并执行响应的 I/O 操作

if old == pdReady {

*gpp = 0

return true

}

if old != 0 {

throw("runtime: double wait")

}

// 如果没有期待的 I/O 事件发生,则通过原子操作把 gpp 的值置为 pdWait 并退出 for 循环

if atomic.Casuintptr(gpp, 0, pdWait) {

break

}

}

// need to recheck error states after setting gpp to WAIT

// this is necessary because runtime_pollUnblock/runtime_pollSetDeadline/deadlineimpl

// do the opposite: store to closing/rd/wd, membarrier, load of rg/wg

// waitio 此时是 false,netpollcheckerr 方法会检查当前 pollDesc 对应的 fd 是否是正常的,

// 通常来说 netpollcheckerr(pd, mode) == 0 是成立的,所以这里会执行 gopark

// 把当前 goroutine 给 park 住,直至对应的 fd 上发生可读/可写或者其他『期待的』I/O 事件为止,

// 然后 unpark 返回,在 gopark 内部会把当前 goroutine 的抽象数据结构 g 存入

// gpp(pollDesc.rg/pollDesc.wg) 指针里,以便在后面的 netpoll 函数取出 pollDesc 之后,

// 把 g 添加到链表里返回,接着重新调度 goroutine

// 不管用户是暂时Read不了还是Write不了,goroutine都会被gopark起来

if waitio || netpollcheckerr(pd, mode) == 0 {

// 注册 netpollblockcommit 回调给 gopark,在 gopark 内部会执行它,保存当前 goroutine 到 gpp

gopark(netpollblockcommit, unsafe.Pointer(gpp), waitReasonIOWait, traceEvGoBlockNet, 5)

}

// be careful to not lose concurrent READY notification

old := atomic.Xchguintptr(gpp, 0)

if old > pdWait {

throw("runtime: corrupted polldesc")

}

return old == pdReady

}

|

gopark 会停住当前的 goroutine 并且调用传递进来的回调函数 unlockf,从上面的源码我们可以知道这个函数是netpollblockcommit,调用 netpollblockcommit,把当前的 goroutine,也就是 g 数据结构保存到 pollDesc 的 rg 或者 wg 指针里

1

2

3

4

5

6

7

8

9

10

11

12

13

|

// netpollblockcommit 在 gopark 函数里被调用

func netpollblockcommit(gp*g, gpp unsafe.Pointer) bool {

// 通过原子操作把当前 goroutine 抽象的数据结构 g,也就是这里的参数 gp 存入 gpp 指针,

// 此时 gpp 的值是 pollDesc 的 rg 或者 wg 指针

r := atomic.Casuintptr((*uintptr)(gpp), pdWait, uintptr(unsafe.Pointer(gp)))

if r {

// Bump the count of goroutines waiting for the poller.

// The scheduler uses this to decide whether to block

// waiting for the poller if there is nothing else to do.

atomic.Xadd(&netpollWaiters, 1)

}

return r

}

|

waitRead/waitWrite/waitCanceled

pollDesc.waitRead/waitWrite/waitCanceled 方法主要负责检测当前这个 pollDesc 是否有『期待的』I/O 事件发生,如果有就直接返回,否则就 park 住当前的 goroutine 并持续等待直至对应的 fd 上发生可读/可写或者其他『期待的』I/O 事件为止,然后它就会返回到外层的 for 循环,让 goroutine 继续执行逻辑。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

|

func (pd *pollDesc) wait(mode int, isFile bool) error {

if pd.runtimeCtx == 0 {

return errors.New("waiting for unsupported file type")

}

res := runtime_pollWait(pd.runtimeCtx, mode)

return convertErr(res, isFile)

}

func (pd *pollDesc) waitRead(isFile bool) error {

return pd.wait('r', isFile)

}

func (pd *pollDesc) waitWrite(isFile bool) error {

return pd.wait('w', isFile)

}

func (pd *pollDesc) waitCanceled(mode int) {

if pd.runtimeCtx == 0 {

return

}

runtime_pollWaitCanceled(pd.runtimeCtx, mode)

}

func (pd *pollDesc) pollable() bool {

return pd.runtimeCtx != 0

}

|

轮询等待

netpoll

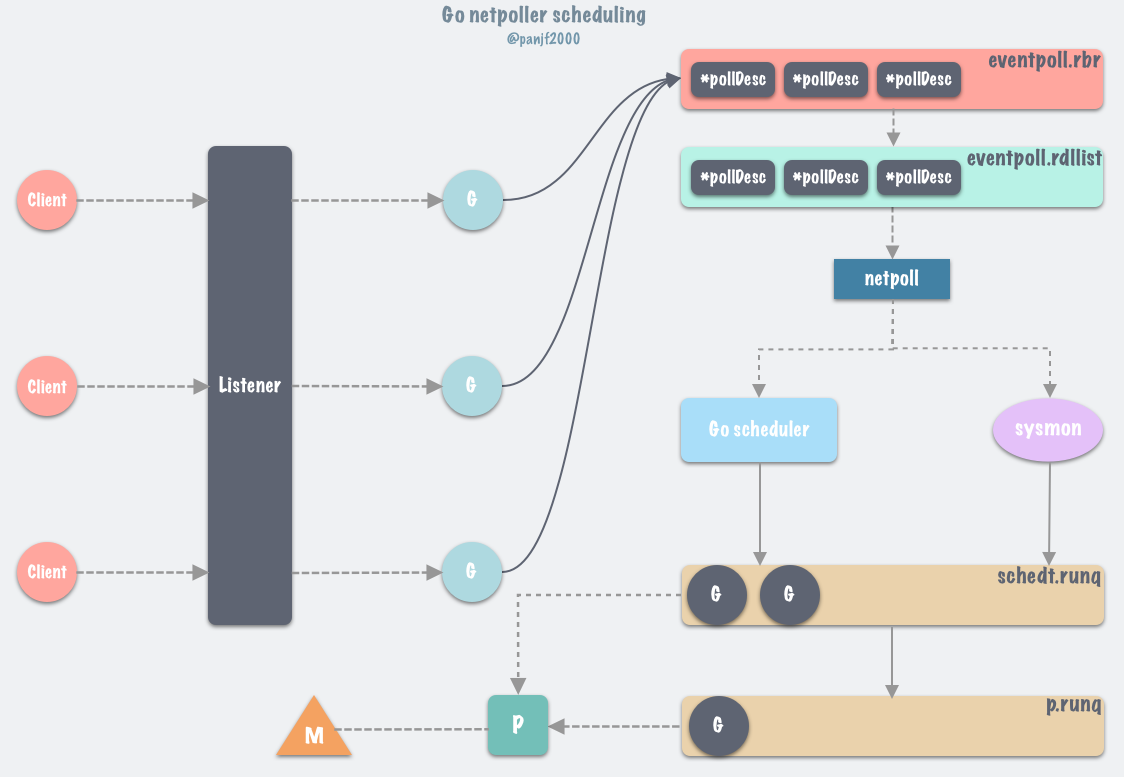

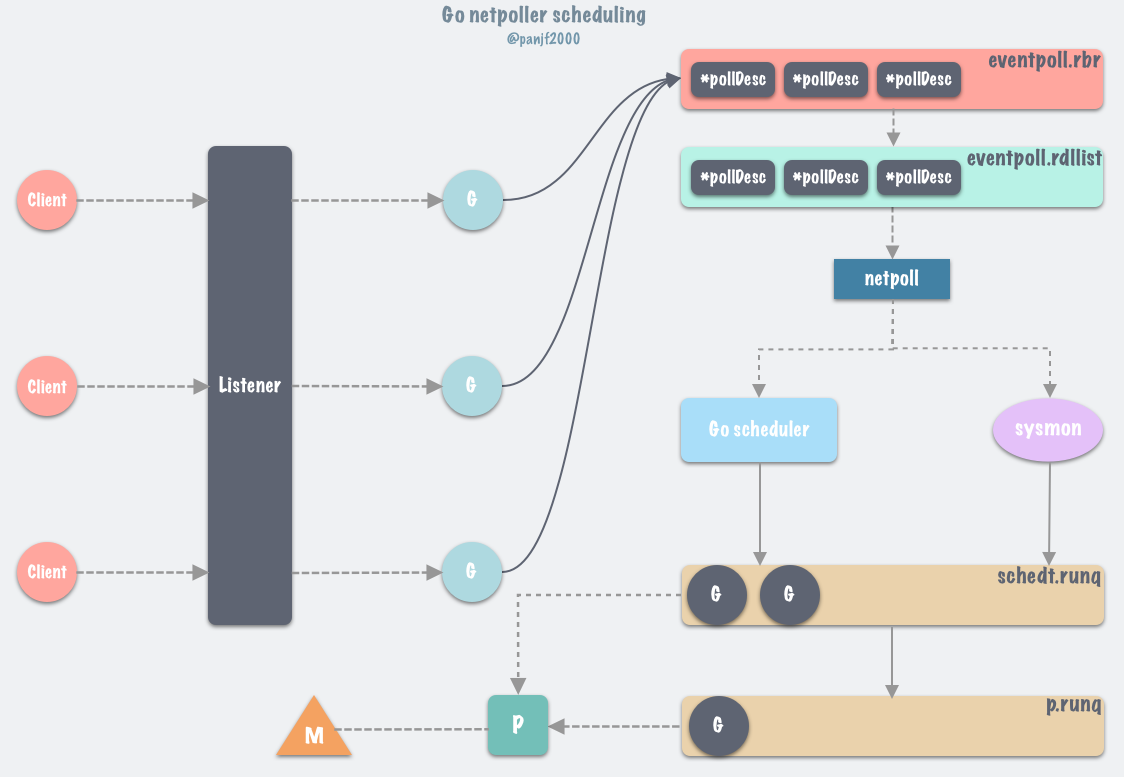

netpoll 里会调用 epoll_wait 从 epoll 的 eventpoll.rdllist 就绪双向链表返回,从而得到 I/O 就绪的 socket fd 列表,并根据取出最初调用 epoll_ctl 时保存的上下文信息,恢复 g。所以执行完netpoll 之后,会返回一个就绪 fd 列表对应的 goroutine 链表.

runtime.netpoll 函数返回的 Goroutine 列表都会被 runtime.injectglist 注入到处理器或者全局的运行队列上,其中因为系统监控 Goroutine 直接运行在线程上,所以它获取的 Goroutine 列表会直接加入全局的运行队列,其他 Goroutine 获取的列表都会加入 Goroutine 所在处理器的运行队列上。

Go 在多种场景下都可能会调用 netpoll 检查文件描述符状态:

- 在 Go runtime scheduler 的核心方法 runtime.schedule() 里会调用一个叫 runtime.findrunable() 的方法获取可运行的 goroutine 来执行,而在 runtime.findrunable() 方法里就调用了 runtime.netpoll 获取已就绪的 fd 列表对应的 goroutine 列表

- sysmon 监控线程会在循环过程中检查距离上一次 runtime.netpoll 被调用是否超过了 10ms,若是则会去调用它拿到可运行的 goroutine 列表并通过调用 injectglist 把 g 列表放入全局调度队列或者当前 P 本地调度队列等待被执行.

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

|

// netpoll checks for ready network connections.

// Returns list of goroutines that become runnable.

// delay < 0: blocks indefinitely

// delay == 0: does not block, just polls

// delay > 0: block for up to that many nanoseconds

func netpoll(delay int64) gList {

if epfd == -1 {

return gList{}

}

// 根据特定的规则把 delay 值转换为 epollwait 的 timeout 值

//因为传入 delay 的单位是纳秒,下面这段代码会将纳秒转换成毫秒:

var waitms int32

if delay < 0 {

waitms = -1

} else if delay == 0 {

waitms = 0

} else if delay < 1e6 {

waitms = 1

} else if delay < 1e15 {

waitms = int32(delay / 1e6)

} else {

// An arbitrary cap on how long to wait for a timer.

// 1e9 ms == ~11.5 days.

waitms = 1e9

}

//计算了需要等待的时间之后,runtime.netpoll 会执行 epollwait 等待文件描述符转换成可读或者可写,如果该函数返回了负值,就可能返回空的 Goroutine 列表或者重新调用 epollwait 陷入等待:

var events [128]epollevent

retry:

// 超时等待就绪的 fd 读写事件

n := epollwait(epfd, &events[0], int32(len(events)), waitms)

if n < 0 {

if n != -_EINTR {

println("runtime: epollwait on fd", epfd, "failed with", -n)

throw("runtime: netpoll failed")

}

// If a timed sleep was interrupted, just return to

// recalculate how long we should sleep now.

if waitms > 0 {

return gList{}

}

goto retry

}

//当 epollwait 函数返回的值大于 0 时,就意味着被监控的文件描述符出现了待处理的事件,我们在如下所示的循环中就会依次处理这些事件:

// toRun 是一个 g 的链表,存储要恢复的 goroutines,最后返回给调用方

var toRun gList

for i := int32(0); i < n; i++ {

ev := &events[i]

if ev.events == 0 {

continue

}

// Go scheduler 在调用 findrunnable() 寻找 goroutine 去执行的时候,

// 在调用 netpoll 之时会检查当前是否有其他线程同步阻塞在 netpoll,

// 若是,则调用 netpollBreak 来唤醒那个线程,避免它长时间阻塞

if *(**uintptr)(unsafe.Pointer(&ev.data)) == &netpollBreakRd {

if ev.events != _EPOLLIN {

println("runtime: netpoll: break fd ready for", ev.events)

throw("runtime: netpoll: break fd ready for something unexpected")

}

if delay != 0 {

// netpollBreak could be picked up by a

// nonblocking poll. Only read the byte

// if blocking.

var tmp [16]byte

read(int32(netpollBreakRd), noescape(unsafe.Pointer(&tmp[0])), int32(len(tmp)))

atomic.Store(&netpollWakeSig, 0)

}

continue

}

// 判断发生的事件类型,读类型或者写类型等,然后给 mode 复制相应的值,

// mode 用来决定从 pollDesc 里的 rg 还是 wg 里取出 goroutine

var mode int32

if ev.events&(_EPOLLIN|_EPOLLRDHUP|_EPOLLHUP|_EPOLLERR) != 0 {

mode += 'r'

}

if ev.events&(_EPOLLOUT|_EPOLLHUP|_EPOLLERR) != 0 {

mode += 'w'

}

if mode != 0 {

// 取出保存在 epollevent 里的 pollDesc

pd := *(**pollDesc)(unsafe.Pointer(&ev.data))

pd.everr = false

if ev.events == _EPOLLERR {

pd.everr = true

}

// 调用 netpollready,传入就绪 fd 的 pollDesc,

// 把 fd 对应的 goroutine 添加到链表 toRun 中

netpollready(&toRun, pd, mode)

}

}

return toRun

}

|

处理的事件总共包含两种.

netpollBreak

一种是调用 runtime.netpollBreak 函数触发的事件,该函数的作用是中断网络轮询器;

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

|

// netpollBreak 往通信管道里写入信号去唤醒 epollwait

func netpollBreak() {

// 通过 CAS 避免重复的唤醒信号被写入管道,

// 从而减少系统调用并节省一些系统资源

if atomic.Cas(&netpollWakeSig, 0, 1) {

for {

var b byte

n := write(netpollBreakWr, unsafe.Pointer(&b), 1)

if n == 1 {

break

}

if n == -_EINTR {

continue

}

if n == -_EAGAIN {

return

}

println("runtime: netpollBreak write failed with", -n)

throw("runtime: netpollBreak write failed")

}

}

}

|

netpollready

另一种是其他文件描述符的正常读写事件,对于这些事件,我们会交给 runtime.netpollready 处理:

已经 ready 的 goroutine push 到 toRun 链表

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

|

// netpollready 调用 netpollunblock 返回就绪 fd 对应的 goroutine 的抽象数据结构 g

// netpollready is called by the platform-specific netpoll function.

// It declares that the fd associated with pd is ready for I/O.

// The toRun argument is used to build a list of goroutines to return

// from netpoll. The mode argument is 'r', 'w', or 'r'+'w' to indicate

// whether the fd is ready for reading or writing or both.

//

// This may run while the world is stopped, so write barriers are not allowed.

//go:nowritebarrier

func netpollready(toRun *gList, pd *pollDesc, mode int32) {

var rg, wg *g

if mode == 'r' || mode == 'r'+'w' {

rg = netpollunblock(pd, 'r', true)

}

if mode == 'w' || mode == 'r'+'w' {

wg = netpollunblock(pd, 'w', true)

}

if rg != nil {

toRun.push(rg)

}

if wg != nil {

toRun.push(wg)

}

}

|

toRun 列表最终从 netpoll() 中返回,通过 injectglist 进入全局队列

netpollunblock

runtime.netpollunblock会在读写事件发生时,将 runtime.pollDesc 中的读或者写信号量转换成 pdReady 并返回其中存储的 Goroutine;如果返回的 Goroutine 不会为空,那么该 Goroutine 就会被加入 toRun 列表,运行时会将列表中的全部 Goroutine 加入运行队列并等待调度器的调度。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

|

// netpollunblock 会依据传入的 mode 决定从 pollDesc 的 rg 或者 wg 取出当时 gopark 之时存入的

// goroutine 抽象数据结构 g 并返回

func netpollunblock(pd *pollDesc, mode int32, ioready bool) *g {

// mode == 'r' 代表当时 gopark 是为了等待读事件,而 mode == 'w' 则代表是等待写事件

gpp := &pd.rg

if mode == 'w' {

gpp = &pd.wg

}

for {

// 取出 gpp 存储的 g

old := *gpp

if old == pdReady {

return nil

}

if old == 0 && !ioready {

// Only set READY for ioready. runtime_pollWait

// will check for timeout/cancel before waiting.

return nil

}

var new uintptr

if ioready {

new = pdReady

}

// 重置 pollDesc 的 rg 或者 wg

if atomic.Casuintptr(gpp, old, new) {

// 如果该 goroutine 还是必须等待,则返回 nil

if old == pdWait {

old = 0

}

// 通过万能指针还原成 g 并返回

return (*g)(unsafe.Pointer(old))

}

}

}

|

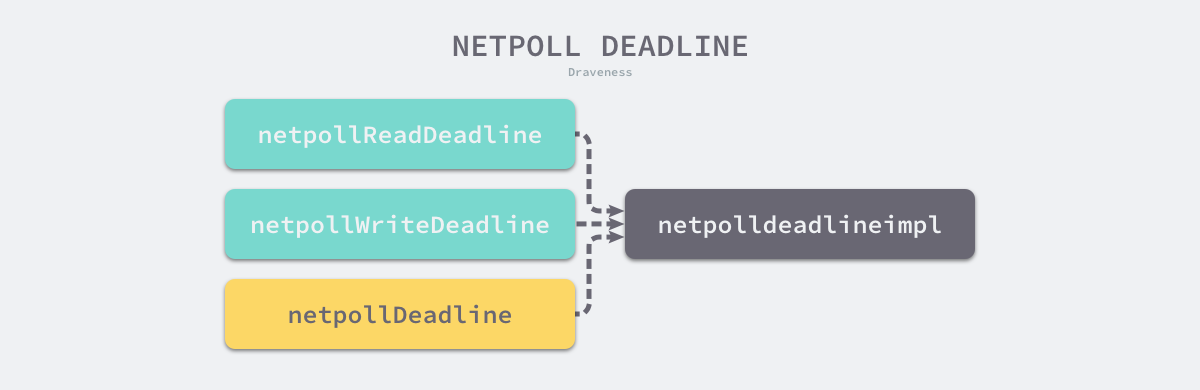

截止日期

pollSetDeadline

网络轮询器和计时器的关系非常紧密,这不仅仅是因为网络轮询器负责计时器的唤醒,还因为文件和网络 I/O 的截止日期也由网络轮询器负责处理。截止日期在 I/O 操作中,尤其是网络调用中很关键,网络请求存在很高的不确定因素,我们需要设置一个截止日期保证程序的正常运行,这时就需要用到网络轮询器中的 runtime.poll_runtime_pollSetDeadline 函数.

该函数会先使用截止日期计算出过期的时间点,然后根据 runtime.pollDesc 的状态做出以下不同的处理:

- 如果结构体中的计时器没有设置执行的函数时,该函数会设置计时器到期后执行的函数、传入的参数并调用 runtime.resettimer 重置计时器;

- 如果结构体的读截止日期已经被改变,我们会根据新的截止日期做出不同的处理:

- 如果新的截止日期大于 0,调用 runtime.modtimer 修改计时器;

- 如果新的截止日期小于 0,调用 runtime.deltimer 删除计时器;

在 runtime.poll_runtime_pollSetDeadline 函数的最后,会重新检查轮询信息中存储的截止日期

如果截止日期小于 0,上述代码会调用 runtime.netpollgoready 直接唤醒对应的 Goroutine。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

|

func poll_runtime_pollSetDeadline(pd *pollDesc, d int64, mode int) {

lock(&pd.lock)

if pd.closing {

unlock(&pd.lock)

return

}

rd0, wd0 := pd.rd, pd.wd

combo0 := rd0 > 0 && rd0 == wd0

if d > 0 {

d += nanotime()

if d <= 0 {

// If the user has a deadline in the future, but the delay calculation

// overflows, then set the deadline to the maximum possible value.

d = 1<<63 - 1

}

}

if mode == 'r' || mode == 'r'+'w' {

pd.rd = d

}

if mode == 'w' || mode == 'r'+'w' {

pd.wd = d

}

combo := pd.rd > 0 && pd.rd == pd.wd

rtf := netpollReadDeadline

if combo {

rtf = netpollDeadline

}

if pd.rt.f == nil {

if pd.rd > 0 {

pd.rt.f = rtf

// Copy current seq into the timer arg.

// Timer func will check the seq against current descriptor seq,

// if they differ the descriptor was reused or timers were reset.

pd.rt.arg = pd.makeArg()

pd.rt.seq = pd.rseq

resettimer(&pd.rt, pd.rd)

}

} else if pd.rd != rd0 || combo != combo0 {

pd.rseq++ // invalidate current timers

if pd.rd > 0 {

modtimer(&pd.rt, pd.rd, 0, rtf, pd.makeArg(), pd.rseq)

} else {

deltimer(&pd.rt)

pd.rt.f = nil

}

}

if pd.wt.f == nil {

if pd.wd > 0 && !combo {

pd.wt.f = netpollWriteDeadline

pd.wt.arg = pd.makeArg()

pd.wt.seq = pd.wseq

resettimer(&pd.wt, pd.wd)

}

} else if pd.wd != wd0 || combo != combo0 {

pd.wseq++ // invalidate current timers

if pd.wd > 0 && !combo {

modtimer(&pd.wt, pd.wd, 0, netpollWriteDeadline, pd.makeArg(), pd.wseq)

} else {

deltimer(&pd.wt)

pd.wt.f = nil

}

}

// If we set the new deadline in the past, unblock currently pending IO if any.

var rg, wg *g

if pd.rd < 0 || pd.wd < 0 {

atomic.StorepNoWB(noescape(unsafe.Pointer(&wg)), nil) // full memory barrier between stores to rd/wd and load of rg/wg in netpollunblock

if pd.rd < 0 {

rg = netpollunblock(pd, 'r', false)

}

if pd.wd < 0 {

wg = netpollunblock(pd, 'w', false)

}

}

unlock(&pd.lock)

if rg != nil {

netpollgoready(rg, 3)

}

if wg != nil {

netpollgoready(wg, 3)

}

}

|

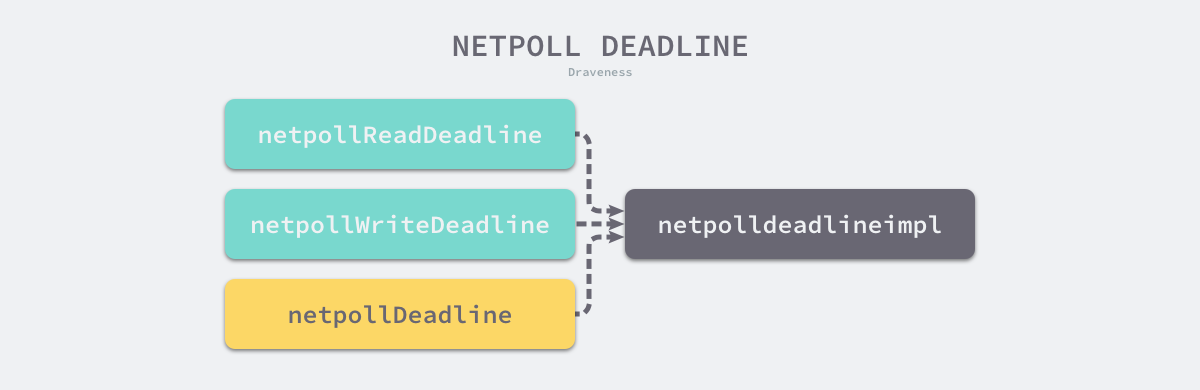

在 runtime.poll_runtime_pollSetDeadline 函数中直接调用 runtime.netpollgoready 是相对比较特殊的情况。在正常情况下,运行时都会在计时器到期时调用 runtime.netpollDeadline、runtime.netpollReadDeadline 和 runtime.netpollWriteDeadline 三个函数:

上述三个函数都会通过 runtime.netpolldeadlineimpl 调用 runtime.netpollgoready 直接唤醒相应的 Goroutine:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

|

func netpolldeadlineimpl(pd *pollDesc, seq uintptr, read, write bool) {

lock(&pd.lock)

// Seq arg is seq when the timer was set.

// If it's stale, ignore the timer event.

currentSeq := pd.rseq

if !read {

currentSeq = pd.wseq

}

if seq != currentSeq {

// The descriptor was reused or timers were reset.

unlock(&pd.lock)

return

}

var rg *g

if read {

if pd.rd <= 0 || pd.rt.f == nil {

throw("runtime: inconsistent read deadline")

}

pd.rd = -1

atomic.StorepNoWB(unsafe.Pointer(&pd.rt.f), nil) // full memory barrier between store to rd and load of rg in netpollunblock

rg = netpollunblock(pd, 'r', false)

}

var wg *g

if write {

if pd.wd <= 0 || pd.wt.f == nil && !read {

throw("runtime: inconsistent write deadline")

}

pd.wd = -1

atomic.StorepNoWB(unsafe.Pointer(&pd.wt.f), nil) // full memory barrier between store to wd and load of wg in netpollunblock

wg = netpollunblock(pd, 'w', false)

}

unlock(&pd.lock)

if rg != nil {

netpollgoready(rg, 0)

}

if wg != nil {

netpollgoready(wg, 0)

}

}

func netpollDeadline(arg interface{}, seq uintptr) {

netpolldeadlineimpl(arg.(*pollDesc), seq, true, true)

}

func netpollReadDeadline(arg interface{}, seq uintptr) {

netpolldeadlineimpl(arg.(*pollDesc), seq, true, false)

}

func netpollWriteDeadline(arg interface{}, seq uintptr) {

netpolldeadlineimpl(arg.(*pollDesc), seq, false, true)

}

|

Goroutine 在被唤醒之后就会意识到当前的 I/O 操作已经超时,可以根据需要选择重试请求或者中止调用。

TCP Server

使用 Go 编写一个典型的 TCP echo server:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

|

package main

import (

"log"

"net"

)

func main() {

listen, err := net.Listen("tcp", ":8888")

if err != nil {

log.Println("listen error: ", err)

return

}

for {

conn, err := listen.Accept()

if err != nil {

log.Println("accept error: ", err)

break

}

// start a new goroutine to handle the new connection.

go HandleConn(conn)

}

}

func HandleConn(conn net.Conn) {

defer conn.Close()

packet := make([]byte, 1024)

for {

// block here if socket is not available for reading data.

n, err := conn.Read(packet)

if err != nil {

log.Println("read socket error: ", err)

return

}

// same as above, block here if socket is not available for writing.

_,_ = conn.Write(packet[:n])

}

}

|

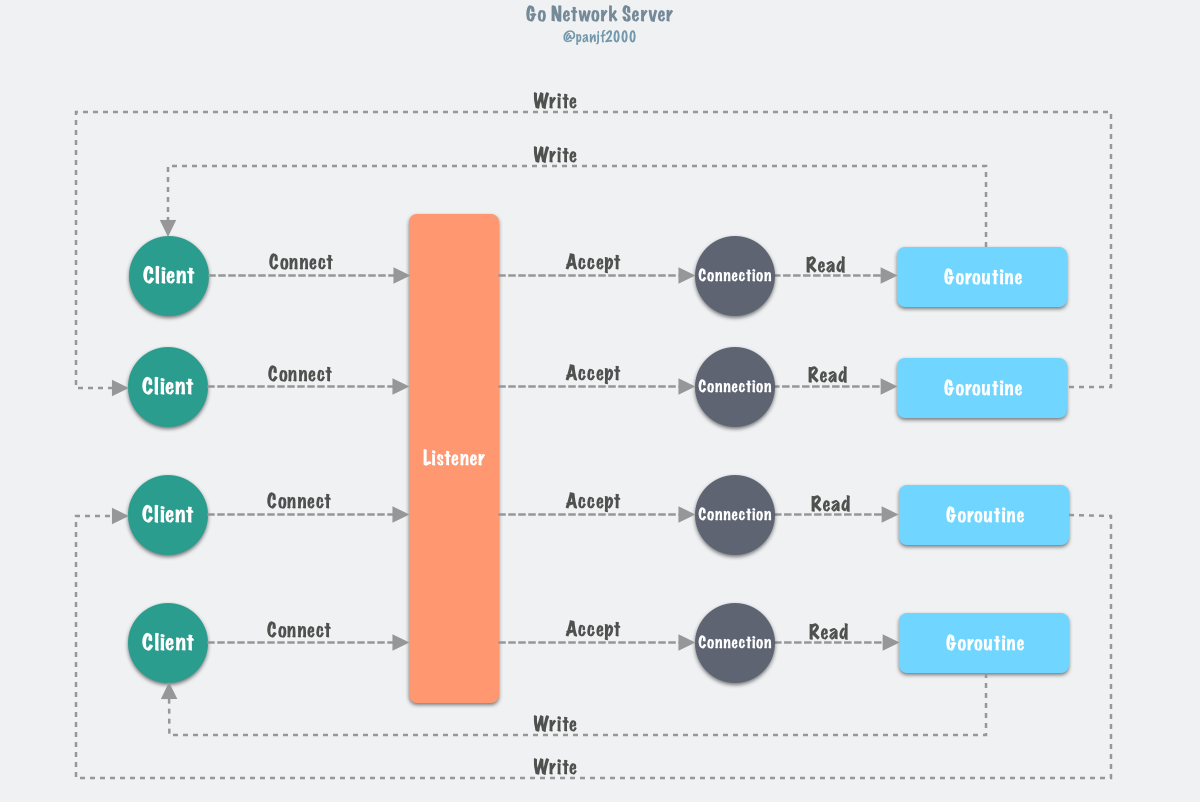

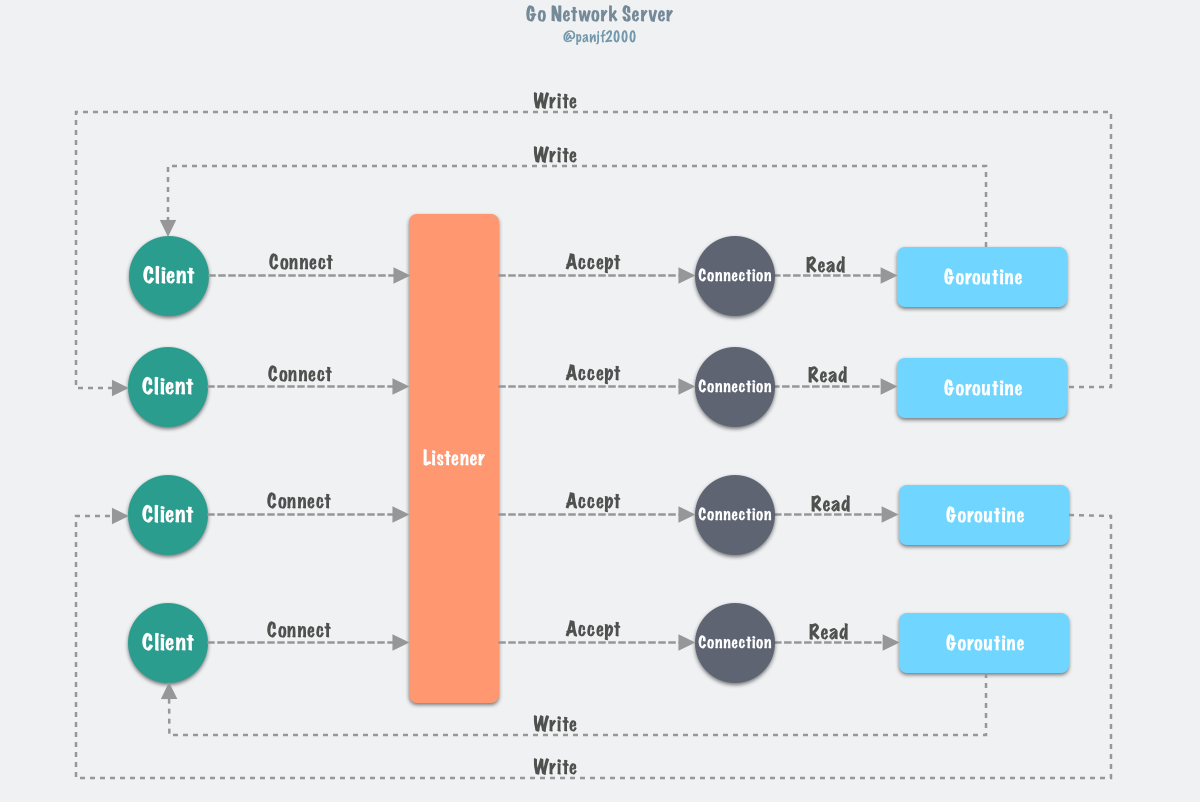

上面是一个基于 Go 原生网络模型(基于 netpoller)编写的一个 TCP server,模式是 goroutine-per-connection ,在这种模式下,开发者使用的是同步的模式去编写异步的逻辑而且对于开发者来说 I/O 是否阻塞是无感知的,也就是说开发者无需考虑 goroutines 甚至更底层的线程、进程的调度和上下文切换。而 Go netpoller 最底层的事件驱动技术肯定是基于 epoll/kqueue/iocp 这一类的 I/O 事件驱动技术,只不过是把这些调度和上下文切换的工作转移到了 runtime 的 Go scheduler,让它来负责调度 goroutines,从而极大地降低了程序员的心智负担!

Go 的这种同步模式的网络服务器的基本架构通常如下:

TCPListener

net.Listen("tcp", ":8888")方法返回了一个 *TCPListener,它是一个实现了 net.Listener 接口的 struct.

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

|

// TCPListener is a TCP network listener. Clients should typically

// use variables of type Listener instead of assuming TCP.

type TCPListener struct {

fd *netFD

lc ListenConfig

}

// Accept implements the Accept method in the Listener interface; it

// waits for the next call and returns a generic Conn.

func (l*TCPListener) Accept() (Conn, error) {

if !l.ok() {

return nil, syscall.EINVAL

}

c, err := l.accept()

if err != nil {

return nil, &OpError{Op: "accept", Net: l.fd.net, Source: nil, Addr: l.fd.laddr, Err: err}

}

return c, nil

}

func (ln *TCPListener) accept() (*TCPConn, error) {

fd, err := ln.fd.accept()

if err != nil {

return nil, err

}

tc := newTCPConn(fd)

if ln.lc.KeepAlive >= 0 {

setKeepAlive(fd, true)

ka := ln.lc.KeepAlive

if ln.lc.KeepAlive == 0 {

ka = defaultTCPKeepAlive

}

setKeepAlivePeriod(fd, ka)

}

return tc, nil

}

|

TCPConn

通过 listener.Accept() 接收的新连接*TCPConn 是一个实现了 net.Conn 接口的 struct,它内嵌了 net.conn struct。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

|

// TCPConn is an implementation of the Conn interface for TCP network

// connections.

type TCPConn struct {

conn

}

// Conn

type conn struct {

fd *netFD

}

type conn struct {

fd*netFD

}

func (c *conn) ok() bool { return c != nil && c.fd != nil }

// Implementation of the Conn interface.

// Read implements the Conn Read method.

func (c*conn) Read(b []byte) (int, error) {

if !c.ok() {

return 0, syscall.EINVAL

}

n, err := c.fd.Read(b)

if err != nil && err != io.EOF {

err = &OpError{Op: "read", Net: c.fd.net, Source: c.fd.laddr, Addr: c.fd.raddr, Err: err}

}

return n, err

}

// Write implements the Conn Write method.

func (c *conn) Write(b []byte) (int, error) {

if !c.ok() {

return 0, syscall.EINVAL

}

n, err := c.fd.Write(b)

if err != nil {

err = &OpError{Op: "write", Net: c.fd.net, Source: c.fd.laddr, Addr: c.fd.raddr, Err: err}

}

return n, err

}

|

netFD

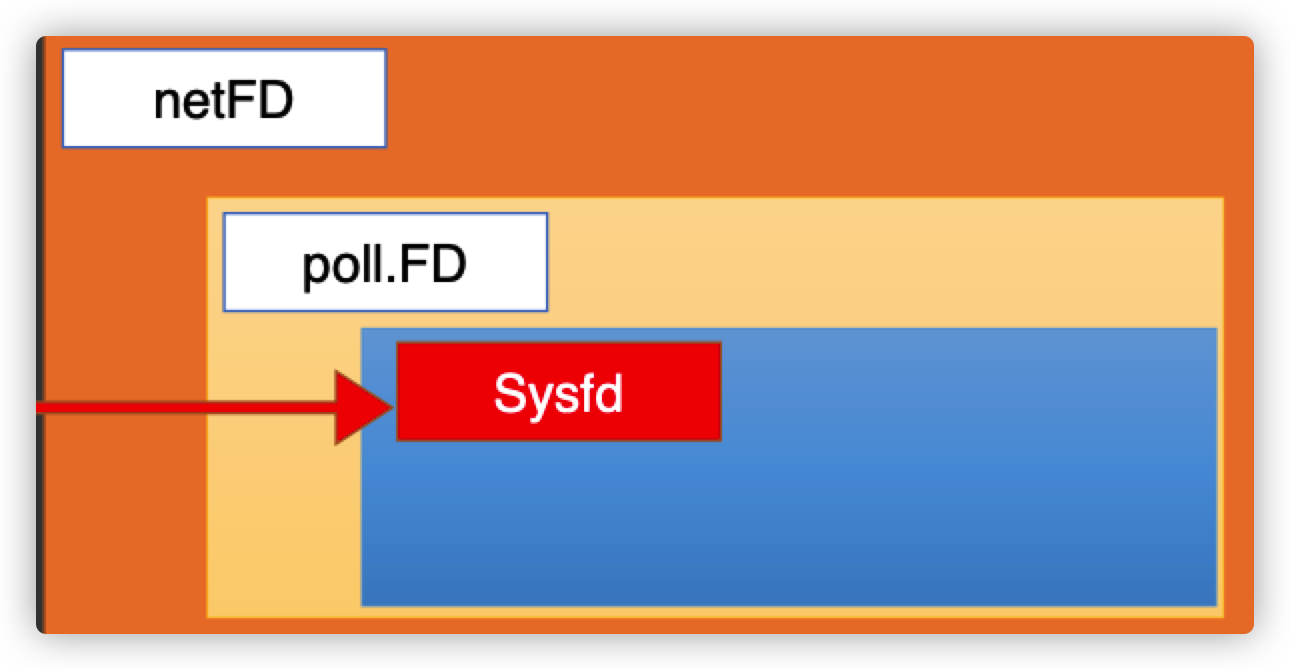

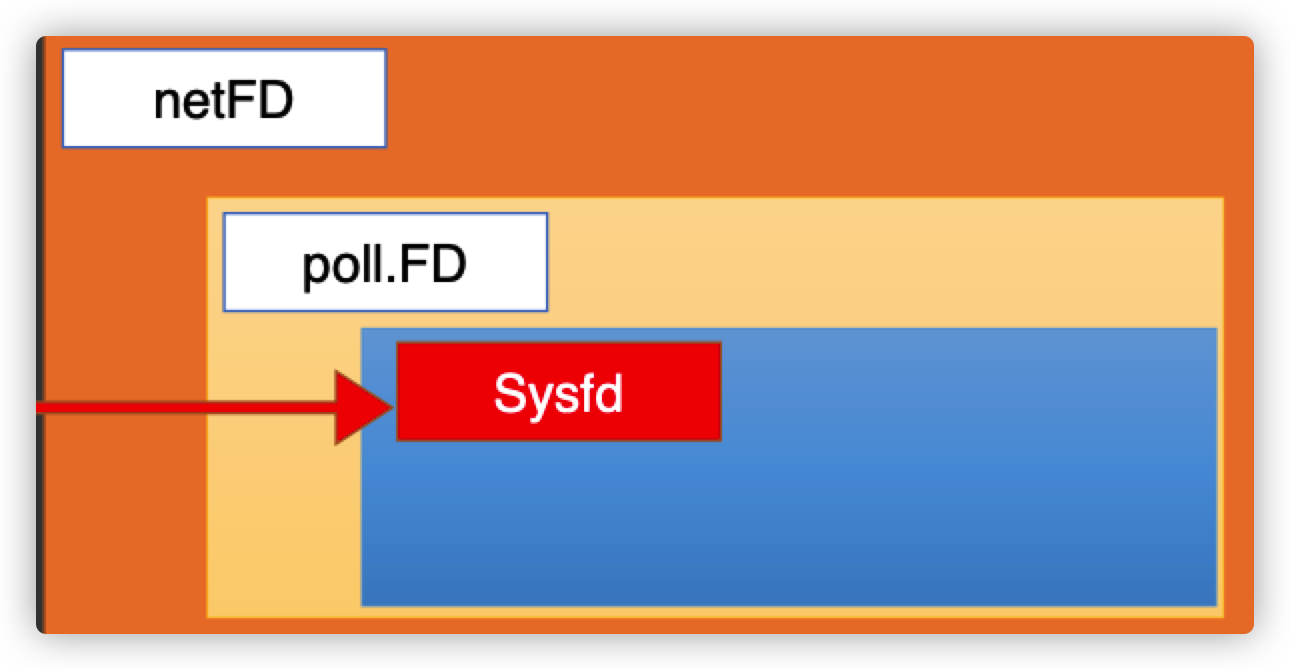

不管是 Listener 的 Accept 还是 Conn 的 Read/Write 方法,都是基于一个 netFD 的数据结构的操作, netFD 是一个网络描述符,类似于 Linux 的文件描述符的概念,netFD 中包含一个 poll.FD 数据结构,而 poll.FD 中包含两个重要的数据结构 Sysfd 和 pollDesc,前者是真正的系统文件描述符,后者对是底层事件驱动的封装,所有的读写超时等操作都是通过调用后者的对应方法实现的。

netFD 和 poll.FD 的源码:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

|

// Network file descriptor.

type netFD struct {

pfd poll.FD

// immutable until Close

family int

sotype int

isConnected bool // handshake completed or use of association with peer

net string

laddr Addr

raddr Addr

}

// FD is a file descriptor. The net and os packages use this type as a

// field of a larger type representing a network connection or OS file.

// windows和linux对这个poll.FD的定义是有些区别的

type FD struct {

// Lock sysfd and serialize access to Read and Write methods.

//这个锁是为了保证对同一个文件的读、写操作能分别被序列化

fdmu fdMutex

// System file descriptor. Immutable until Close.

// 这个是操作系统给我们返回的fd值

Sysfd int

// I/O poller.

// I/0 poller.这是Go对poll过程的一个抽象,所有平台的抽象都是一样的

pd pollDesc

// Writev cache.

iovecs *[]syscall.Iovec

//文件被关闭时会触发该sema

// Semaphore signaled when file is closed.

csema uint32

// 如果非0,说明FD被设置为了blocking模式

// Non-zero if this file has been set to blocking mode.

isBlocking uint32

// Whether this is a streaming descriptor, as opposed to a

// packet-based descriptor like a UDP socket. Immutable.

// 区分这个是不是一个流式的FD,与流式相反的是基于packet的,即UDP socket。该值不可变

IsStream bool

// Whether a zero byte read indicates EOF. This is false for a

// message based socket connection.

// 当连接读到0长度时,用来区分是否代表EOF。如果是基于消息的socket连接始终是false

ZeroReadIsEOF bool

// Whether this is a file rather than a network socket.

// 区分这个FD代表的是文件,还是网络连接

isFile bool

}

|

1

2

3

4

5

6

7

8

9

10

11

12

13

|

func newFD(sysfd, family, sotype int, net string) (*netFD, error) {

ret := &netFD{

pfd: poll.FD{

Sysfd: sysfd,

IsStream: sotype == syscall.SOCK_STREAM,

ZeroReadIsEOF: sotype != syscall.SOCK_DGRAM && sotype != syscall.SOCK_RAW,

},

family: family,

sotype: sotype,

net: net,

}

return ret, nil

}

|

init 过程调用链:netFD.init() –> poll.FD.Init() –> poll.pollDesc.init()

1

2

3

|

func (fd *netFD) init() error {

return fd.pfd.Init(fd.net, true)

}

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

|

// Init initializes the FD. The Sysfd field should already be set.

// This can be called multiple times on a single FD.

// The net argument is a network name from the net package (e.g., "tcp"),

// or "file".

// Set pollable to true if fd should be managed by runtime netpoll.

// netFD.init 会调用 poll.FD.Init 并最终调用到 pollDesc.init,

func (fd *FD) Init(net string, pollable bool) error {

// We don't actually care about the various network types.

if net == "file" {

fd.isFile = true

}

if !pollable {

fd.isBlocking = 1

return nil

}

// netFD.init 会调用 poll.FD.Init 并最终调用到 pollDesc.init,

// 它会创建 epoll 实例并把 listener fd 加入监听队列

err := fd.pd.init(fd)

if err != nil {

// If we could not initialize the runtime poller,

// assume we are using blocking mode.

fd.isBlocking = 1

}

return err

}

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

|

// 使用 sync.Once 来确保一个 listener 只持有一个 epoll 实例

var serverInit sync.Once

// 它会创建 epoll 实例并把 listener fd 加入监听队列

func (pd *pollDesc) init(fd *FD) error {

serverInit.Do(runtime_pollServerInit)

ctx, errno := runtime_pollOpen(uintptr(fd.Sysfd))

if errno != 0 {

if ctx != 0 {

runtime_pollUnblock(ctx)

runtime_pollClose(ctx)

}

return errnoErr(syscall.Errno(errno))

}

pd.runtimeCtx = ctx

return nil

}

|

net.Listen

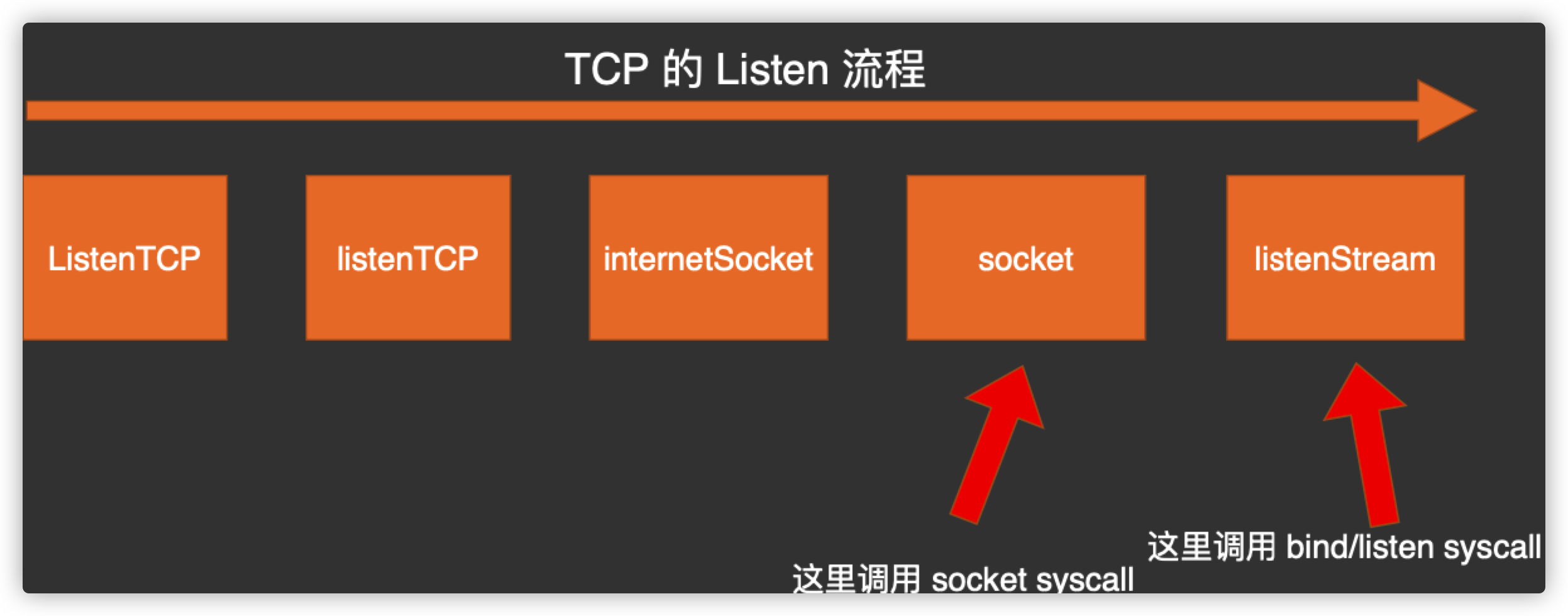

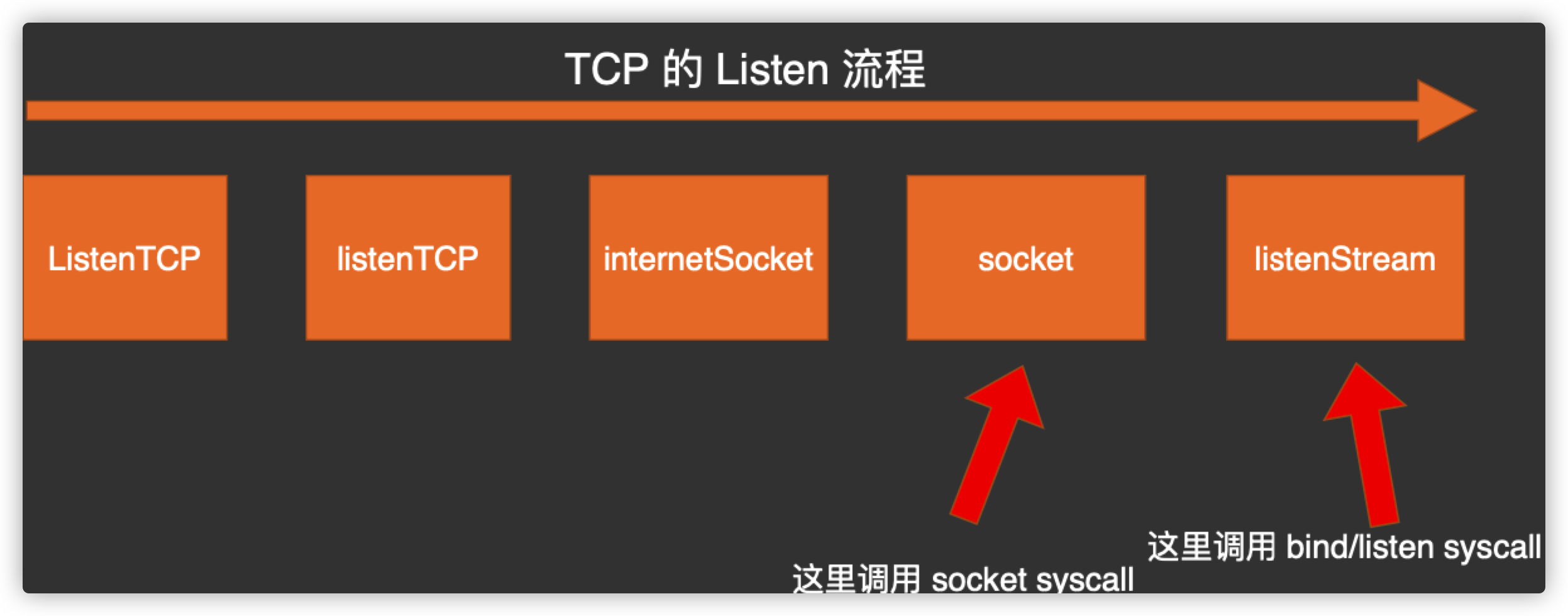

调用 net.Listen 之后,底层调用 Linux 的系统调用 socket.

socket方法创建一个 fd 分配给 listener,并用以来初始化 listener 的 netFD ,接着调用 netFD 的 listenStream 方法完成对 socket 的 bind&listen 操作以及对 netFD 的初始化(主要是对 netFD 里的 pollDesc 的初始化),调用链是 runtime.runtime_pollServerInit --> runtime.poll_runtime_pollServerInit --> runtime.netpollGenericInit.

runtime.netpollGenericInit 会调用平台上特定实现的 runtime.netpollinit 函数,即 Linux 上的 epoll,

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

112

113

114

115

116

117

118

119

120

121

122

123

124

125

126

127

128

129

130

131

132

133

134

135

136

137

138

139

140

141

142

143

144

145

146

147

148

149

150

151

152

153

154

155

156

157

158

159

160

161

162

163

164

165

166

167

168

169

170

171

172

173

174

175

176

177

178

179

180

181

|

func Listen(network, address string) (Listener, error) {

var lc ListenConfig

return lc.Listen(context.Background(), network, address)

}

// Listen announces on the local network address.

//

// See func Listen for a description of the network and address

// parameters.

func (lc *ListenConfig) Listen(ctx context.Context, network, address string) (Listener, error) {

addrs, err := DefaultResolver.resolveAddrList(ctx, "listen", network, address, nil)

if err != nil {

return nil, &OpError{Op: "listen", Net: network, Source: nil, Addr: nil, Err: err}

}

sl := &sysListener{

ListenConfig: *lc,

network: network,

address: address,

}

var l Listener

la := addrs.first(isIPv4)

switch la := la.(type) {

case *TCPAddr:

l, err = sl.listenTCP(ctx, la)

case *UnixAddr:

l, err = sl.listenUnix(ctx, la)

default:

return nil, &OpError{Op: "listen", Net: sl.network, Source: nil, Addr: la, Err: &AddrError{Err: "unexpected address type", Addr: address}}

}

if err != nil {

return nil, &OpError{Op: "listen", Net: sl.network, Source: nil, Addr: la, Err: err} // l is non-nil interface containing nil pointer

}

return l, nil

}

func (sl *sysListener) listenTCP(ctx context.Context, laddr *TCPAddr) (*TCPListener, error) {

fd, err := internetSocket(ctx, sl.network, laddr, nil, syscall.SOCK_STREAM, 0, "listen", sl.ListenConfig.Control)

if err != nil {

return nil, err

}

return &TCPListener{fd: fd, lc: sl.ListenConfig}, nil

}

func internetSocket(ctx context.Context, net string, laddr, raddr sockaddr, sotype, proto int, mode string, ctrlFn func(string, string, syscall.RawConn) error) (fd *netFD, err error) {

if (runtime.GOOS == "aix" || runtime.GOOS == "windows" || runtime.GOOS == "openbsd") && mode == "dial" && raddr.isWildcard() {

raddr = raddr.toLocal(net)

}

family, ipv6only := favoriteAddrFamily(net, laddr, raddr, mode)

return socket(ctx, net, family, sotype, proto, ipv6only, laddr, raddr, ctrlFn)

}

// socket returns a network file descriptor that is ready for

// asynchronous I/O using the network poller.

func socket(ctx context.Context, net string, family, sotype, proto int, ipv6only bool, laddr, raddr sockaddr, ctrlFn func(string, string, syscall.RawConn) error) (fd *netFD, err error) {

s, err := sysSocket(family, sotype, proto)

if err != nil {

return nil, err

}

if err = setDefaultSockopts(s, family, sotype, ipv6only); err != nil {

poll.CloseFunc(s)

return nil, err

}

// 用上面创建的 listener fd 初始化 listener netFD

if fd, err = newFD(s, family, sotype, net); err != nil {

poll.CloseFunc(s)

return nil, err

}

// This function makes a network file descriptor for the

// following applications:

//

// - An endpoint holder that opens a passive stream

// connection, known as a stream listener

//

// - An endpoint holder that opens a destination-unspecific

// datagram connection, known as a datagram listener

//

// - An endpoint holder that opens an active stream or a

// destination-specific datagram connection, known as a

// dialer

//

// - An endpoint holder that opens the other connection, such

// as talking to the protocol stack inside the kernel

//

// For stream and datagram listeners, they will only require

// named sockets, so we can assume that it's just a request

// from stream or datagram listeners when laddr is not nil but

// raddr is nil. Otherwise we assume it's just for dialers or

// the other connection holders.

if laddr != nil && raddr == nil {

switch sotype {

case syscall.SOCK_STREAM, syscall.SOCK_SEQPACKET:

// 对 listener fd 进行 bind&listen 操作,并且调用 init 方法完成初始化

if err := fd.listenStream(laddr, listenerBacklog(), ctrlFn); err != nil {

fd.Close()

return nil, err

}

return fd, nil

case syscall.SOCK_DGRAM:

if err := fd.listenDatagram(laddr, ctrlFn); err != nil {

fd.Close()

return nil, err

}

return fd, nil

}

}

if err := fd.dial(ctx, laddr, raddr, ctrlFn); err != nil {

fd.Close()

return nil, err

}

return fd, nil

}

var (

testHookDialChannel = func() {} // for golang.org/issue/5349

testHookCanceledDial = func() {} // for golang.org/issue/16523

// Placeholders for socket system calls.

socketFunc func(int, int, int) (int, error) = syscall.Socket

connectFunc func(int, syscall.Sockaddr) error = syscall.Connect

listenFunc func(int, int) error = syscall.Listen

getsockoptIntFunc func(int, int, int) (int, error) = syscall.GetsockoptInt

)

// Wrapper around the socket system call that marks the returned file

// descriptor as nonblocking and close-on-exec.

func sysSocket(family, sotype, proto int) (int, error) {

// 调用 linux 系统调用 socket 创建 listener fd 并设置为为阻塞 I/O

s, err := socketFunc(family, sotype|syscall.SOCK_NONBLOCK|syscall.SOCK_CLOEXEC, proto)

// On Linux the SOCK_NONBLOCK and SOCK_CLOEXEC flags were

// introduced in 2.6.27 kernel and on FreeBSD both flags were

// introduced in 10 kernel. If we get an EINVAL error on Linux

// or EPROTONOSUPPORT error on FreeBSD, fall back to using

// socket without them.

switch err {

case nil:

return s, nil

default:

return -1, os.NewSyscallError("socket", err)

case syscall.EPROTONOSUPPORT, syscall.EINVAL:

}

// See ../syscall/exec_unix.go for description of ForkLock.

syscall.ForkLock.RLock()

s, err = socketFunc(family, sotype, proto)

if err == nil {

syscall.CloseOnExec(s)

}

syscall.ForkLock.RUnlock()

if err != nil {

return -1, os.NewSyscallError("socket", err)

}

if err = syscall.SetNonblock(s, true); err != nil {

poll.CloseFunc(s)

return -1, os.NewSyscallError("setnonblock", err)

}

return s, nil

}

// 对 listener fd 进行 bind&listen 操作,并且调用 init 方法完成初始化

func (fd *netFD) listenStream(laddr sockaddr, backlog int, ctrlFn func(string, string, syscall.RawConn) error) error {

...

// 完成绑定操作

if err = syscall.Bind(fd.pfd.Sysfd, lsa); err != nil {

return os.NewSyscallError("bind", err)

}

// 完成监听操作

if err = listenFunc(fd.pfd.Sysfd, backlog); err != nil {

return os.NewSyscallError("listen", err)

}

// 调用 init,内部会调用 poll.FD.Init,最后调用 pollDesc.init

if err = fd.init(); err != nil {

return err

}

lsa, _ = syscall.Getsockname(fd.pfd.Sysfd)

fd.setAddr(fd.addrFunc()(lsa), nil)

return nil

}

|

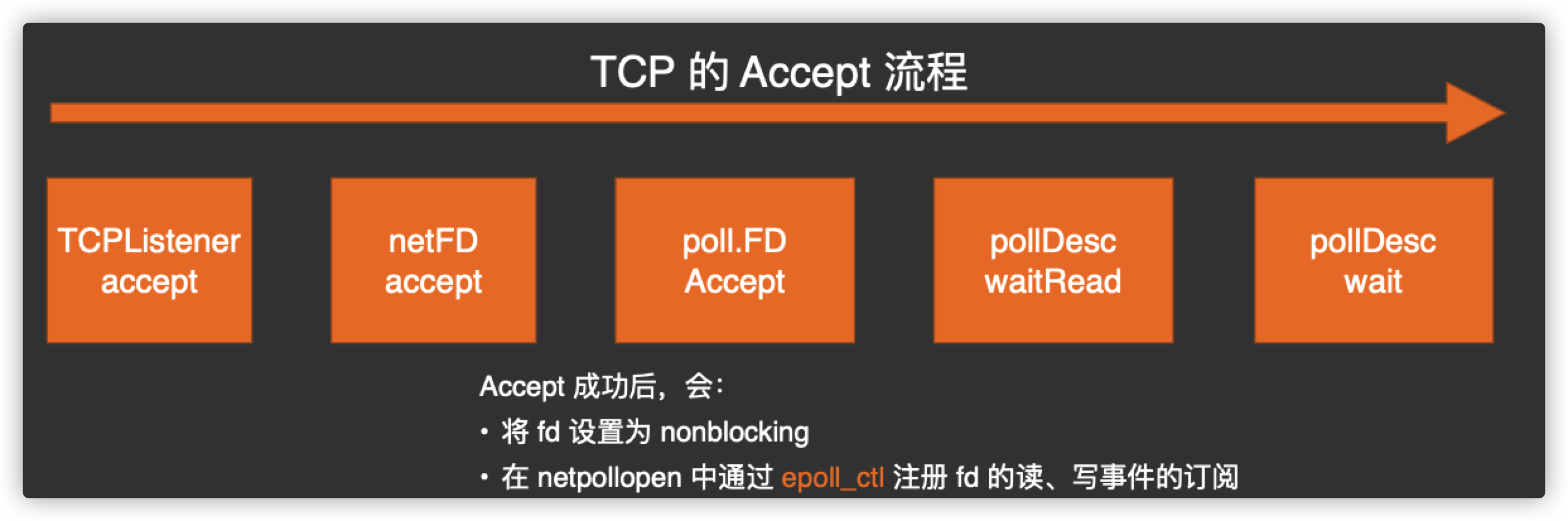

Listener.Accept

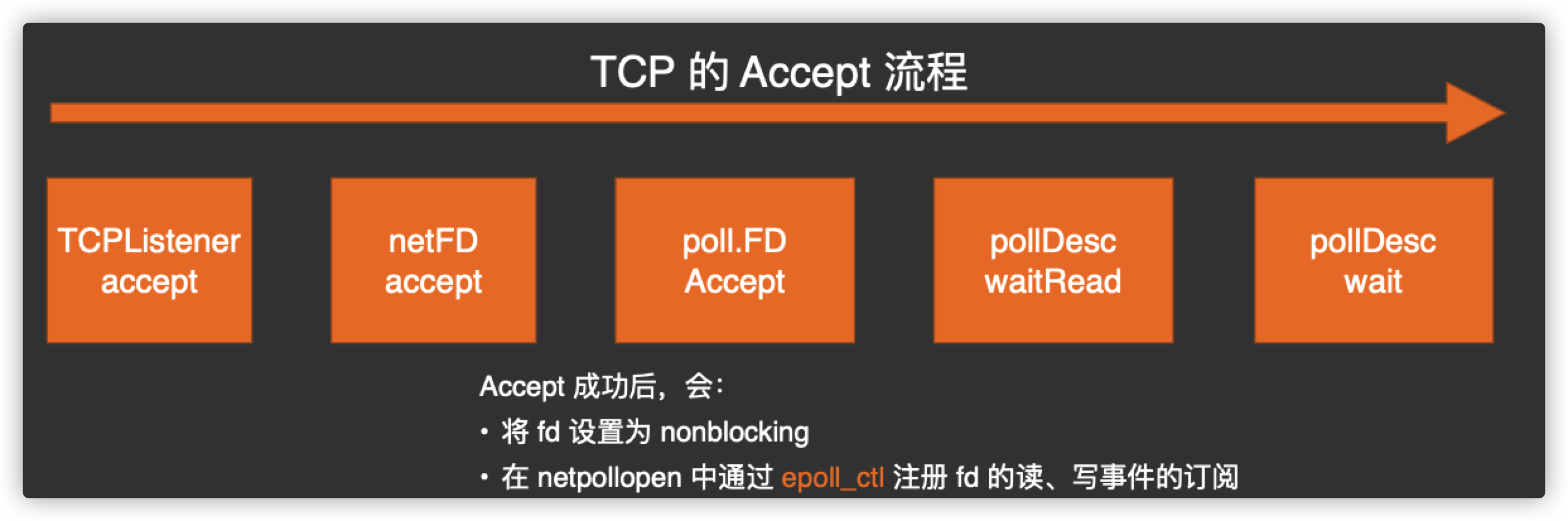

Listener.Accept() 接收来自客户端的新连接.

netpoll accept socket 的工作流程如下:

poll.FD.Accept() 返回之后,会构造一个对应这个新 socket 的 netFD,然后调用 init() 方法完成初始化,然后把这个 socket fd 注册到 listener 的 epoll 实例的事件队列中去,等待 I/O 事件。

netFD 在读写时出现 syscall.EAGAIN 错误,通过 pollDesc 的 waitRead 方法将当前的 goroutine park 住,直到 ready,从 pollDesc 的 waitRead 中返回

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

|

// Accept implements the Accept method in the Listener interface; it

// waits for the next call and returns a generic Conn.

func (l *TCPListener) Accept() (Conn, error) {

if !l.ok() {

return nil, syscall.EINVAL

}

c, err := l.accept()

if err != nil {

return nil, &OpError{Op: "accept", Net: l.fd.net, Source: nil, Addr: l.fd.laddr, Err: err}

}

return c, nil

}

func (ln *TCPListener) accept() (*TCPConn, error) {

fd, err := ln.fd.accept()

if err != nil {

return nil, err

// }

tc := newTCPConn(fd)

if ln.lc.KeepAlive >= 0 {

setKeepAlive(fd, true)

ka := ln.lc.KeepAlive

if ln.lc.KeepAlive == 0 {

ka = defaultTCPKeepAlive

}

setKeepAlivePeriod(fd, ka)

}

return tc, nil

}

func (fd *netFD) accept() (netfd *netFD, err error) {

// 调用 poll.FD 的 Accept 方法接受新的 socket 连接,返回 socket 的 fd

d, rsa, errcall, err := fd.pfd.Accept()

if err != nil {

if errcall != "" {

err = wrapSyscallError(errcall, err)

}

return nil, err

}

// 以 socket fd 构造一个新的 netFD,代表这个新的 socket

if netfd, err = newFD(d, fd.family, fd.sotype, fd.net); err != nil {

poll.CloseFunc(d)

return nil, err

}

// 调用 netFD 的 init 方法完成初始化

if err = netfd.init(); err != nil {

fd.Close()

return nil, err

}

lsa, _ := syscall.Getsockname(netfd.pfd.Sysfd)fff

netfd.setAddr(netfd.addrFunc()(lsa), netfd.addrFunc()(rsa))

return netfd, nil

}

|

netFD.accept 方法里会再调用 poll.FD.Accept ,最后会使用 Linux 的系统调用 accept 来完成新连接的接收,并且会把 accept 的 socket 设置成非阻塞 I/O 模式:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

|

// Accept wraps the accept network call.

func (fd *FD) Accept() (int, syscall.Sockaddr, string, error) {

if err := fd.readLock(); err != nil {

return -1, nil, "", err

}

defer fd.readUnlock()

if err := fd.pd.prepareRead(fd.isFile); err != nil {

return -1, nil, "", err

}

for {

// 使用 linux 系统调用 accept 接收新连接,创建对应的 socket

s, rsa, errcall, err := accept(fd.Sysfd)

// 因为 listener fd 在创建的时候已经设置成非阻塞的了,

// 所以 accept 方法会直接返回,不管有没有新连接到来;如果 err == nil 则表示正常建立新连接,直接返回

if err == nil {

return s, rsa, "", err

}

// 如果 err != nil,则判断 err == syscall.EAGAIN,符合条件则进入 pollDesc.waitRead 方法

switch err {

case syscall.EAGAIN:

if fd.pd.pollable() {

// 如果当前没有发生期待的 I/O 事件,那么 waitRead 会通过 park goroutine 让逻辑 block 在这里

if err = fd.pd.waitRead(fd.isFile); err == nil {

continue

}

}

case syscall.ECONNABORTED:

// This means that a socket on the listen

// queue was closed before we Accept()ed it;

// it's a silly error, so try again.

continue

}

return -1, nil, errcall, err

}

}

// 使用 linux 的 accept 系统调用接收新连接并把这个 socket fd 设置成非阻塞 I/O

ns, sa, err := Accept4Func(s, syscall.SOCK_NONBLOCK|syscall.SOCK_CLOEXEC)

// On Linux the accept4 system call was introduced in 2.6.28

// kernel and on FreeBSD it was introduced in 10 kernel. If we

// get an ENOSYS error on both Linux and FreeBSD, or EINVAL

// error on Linux, fall back to using accept.

// Accept4Func is used to hook the accept4 call.

var Accept4Func func(int, int) (int, syscall.Sockaddr, error) = syscall.Accept4

|

Conn.Read/Conn.Write

- 同一条连接上的读需要被序列化

- 同一条连接上的写需要被序列化

- 读和写可以并发

- 同一个 FD 上的读/写操作,底层是一定有锁的

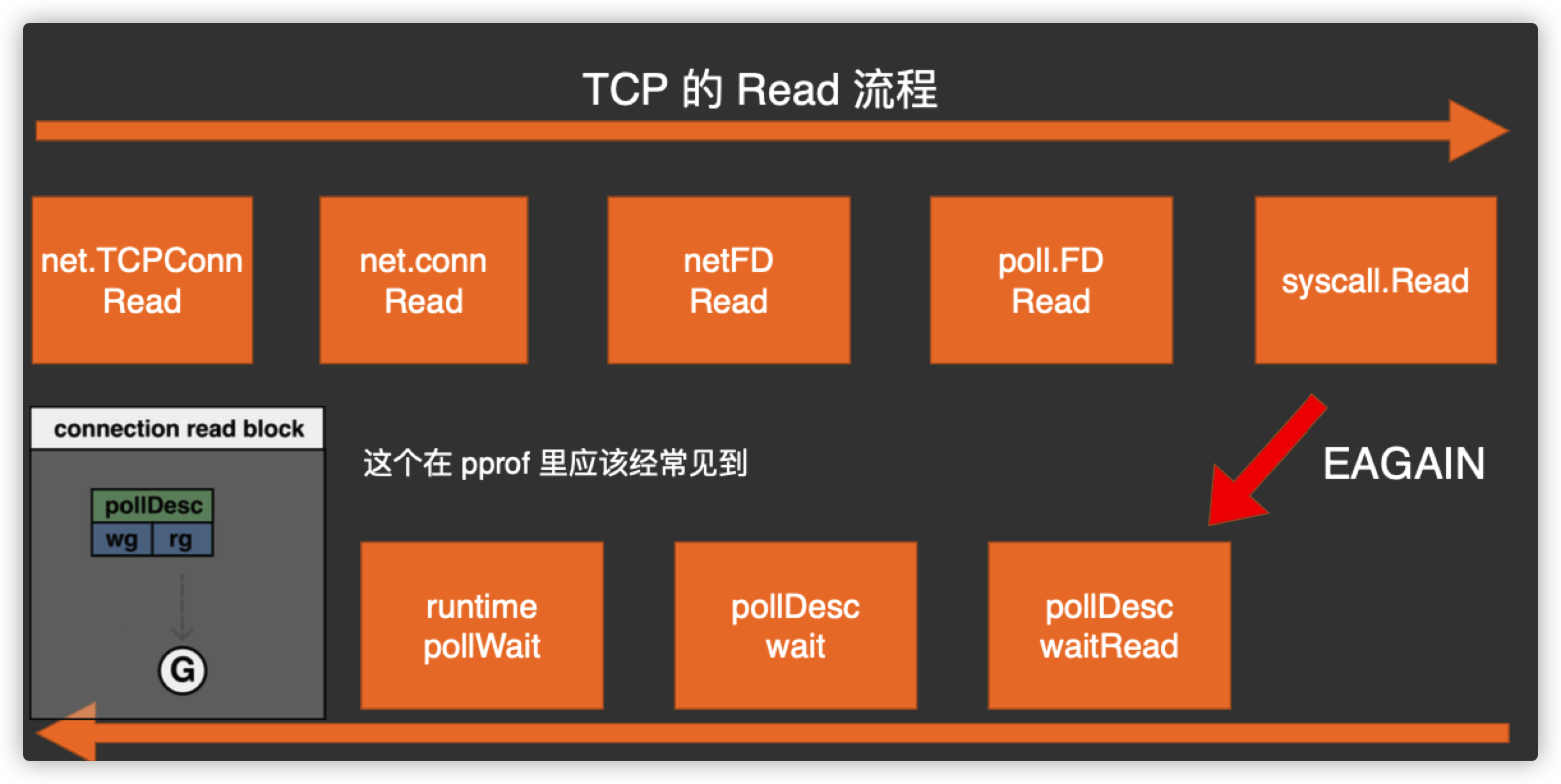

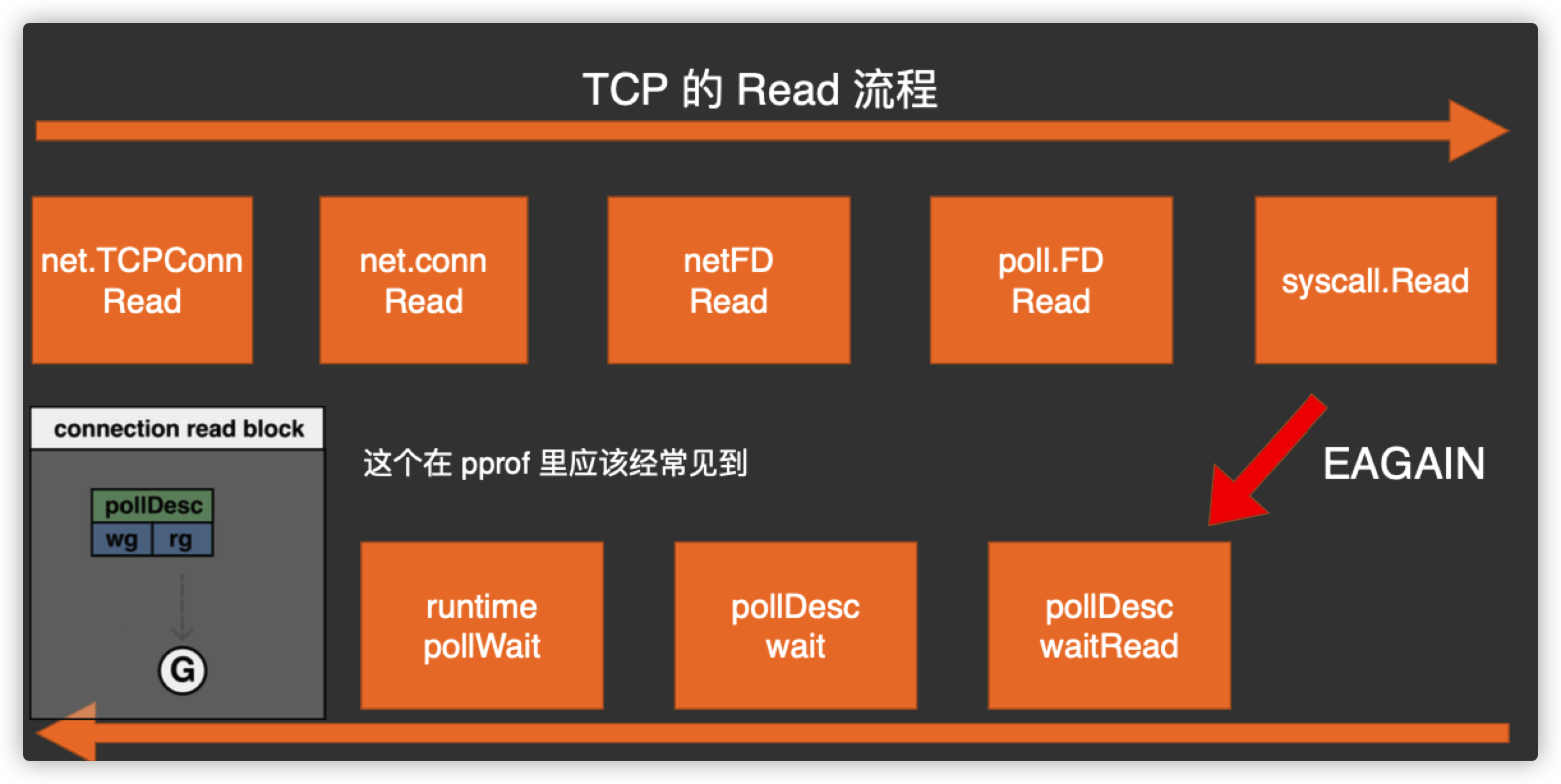

Conn.Read

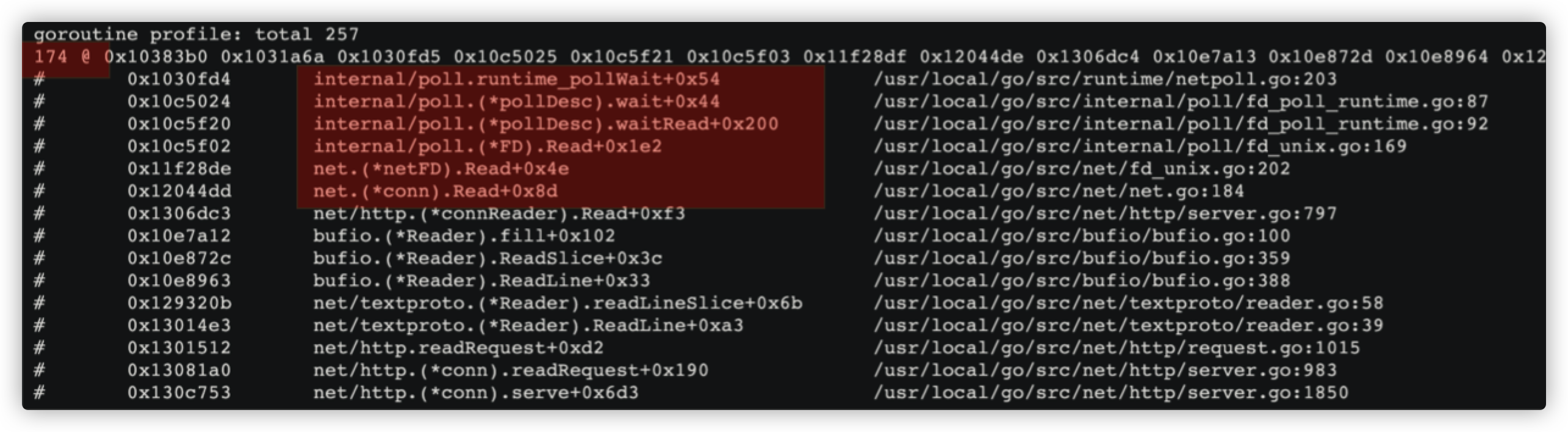

我们先来看看 Conn.Read 方法是如何实现的,原理其实和 Listener.Accept 是一样的,具体调用链还是首先调用 conn 的 netFD.Read ,然后内部再调用 poll.FD.Read ,最后使用 Linux 的系统调用 read: syscall.Read 完成数据读取:

pollDesc.waitRead 内部调用了 poll.runtime_pollWait –> runtime.poll_runtime_pollWait 来达成无 I/O 事件时 park 住 goroutine 的目的

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

|

// Implementation of the Conn interface.

// Read implements the Conn Read method.

func (c *conn) Read(b []byte) (int, error) {

if !c.ok() {

return 0, syscall.EINVAL

}

n, err := c.fd.Read(b)

if err != nil && err != io.EOF {

err = &OpError{Op: "read", Net: c.fd.net, Source: c.fd.laddr, Addr: c.fd.raddr, Err: err}

}

return n, err

}

func (fd*netFD) Read(p []byte) (n int, err error) {

n, err = fd.pfd.Read(p)

runtime.KeepAlive(fd)

return n, wrapSyscallError("read", err)

}

// Read implements io.Reader.

func (fd *FD) Read(p []byte) (int, error) {

// 注意,这里的readLock不是我们常见的read lock,同一条连接的所有read都是彼此互斥的

if err := fd.readLock(); err != nil {

return 0, err

}

defer fd.readUnlock()

if len(p) == 0 {

// If the caller wanted a zero byte read, return immediately

// without trying (but after acquiring the readLock).

// Otherwise syscall.Read returns 0, nil which looks like

// io.EOF.

// TODO(bradfitz): make it wait for readability? (Issue 15735)

return 0, nil

}

if err := fd.pd.prepareRead(fd.isFile); err != nil {

return 0, err

}

if fd.IsStream && len(p) > maxRW {

p = p[:maxRW]

}

for {

// 尝试从该 socket 读取数据,因为 socket 在被 listener accept 的时候设置成

// 了非阻塞 I/O,所以这里同样也是直接返回,不管有没有可读的数据

n, err := syscall.Read(fd.Sysfd, p)

if err != nil {

n = 0

// err == syscall.EAGAIN 表示当前没有期待的 I/O 事件发生,也就是 socket 不可读

if err == syscall.EAGAIN && fd.pd.pollable() {

// 如果当前没有发生期待的 I/O 事件,那么 waitRead

// 会通过 park goroutine 让逻辑 block 在这里

if err = fd.pd.waitRead(fd.isFile); err == nil {

continue

}

}

// On MacOS we can see EINTR here if the user

// pressed ^Z. See issue #22838.

if runtime.GOOS == "darwin" && err == syscall.EINTR {

continue

}

}

err = fd.eofError(n, err)

return n, err

}

}

|

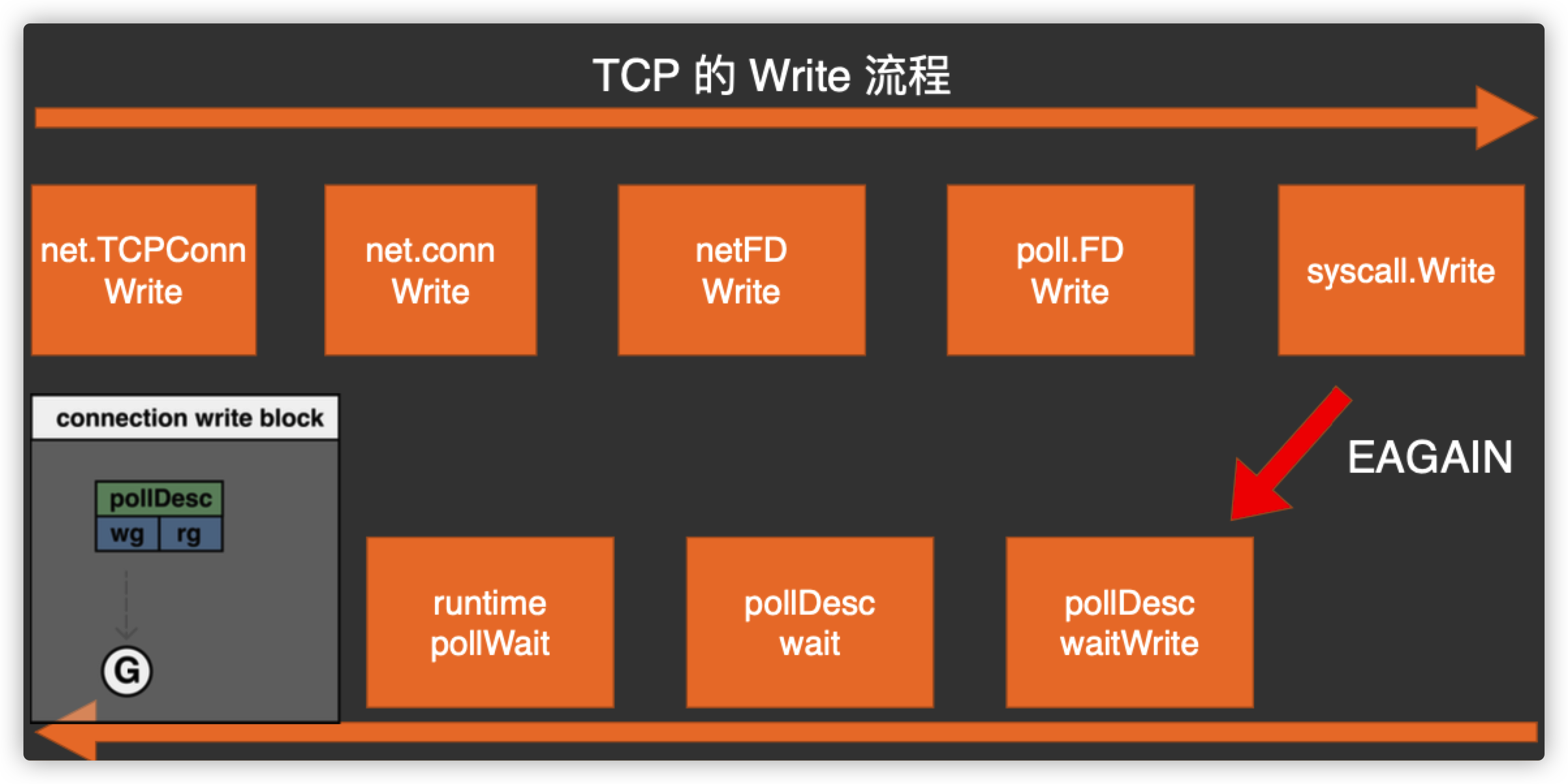

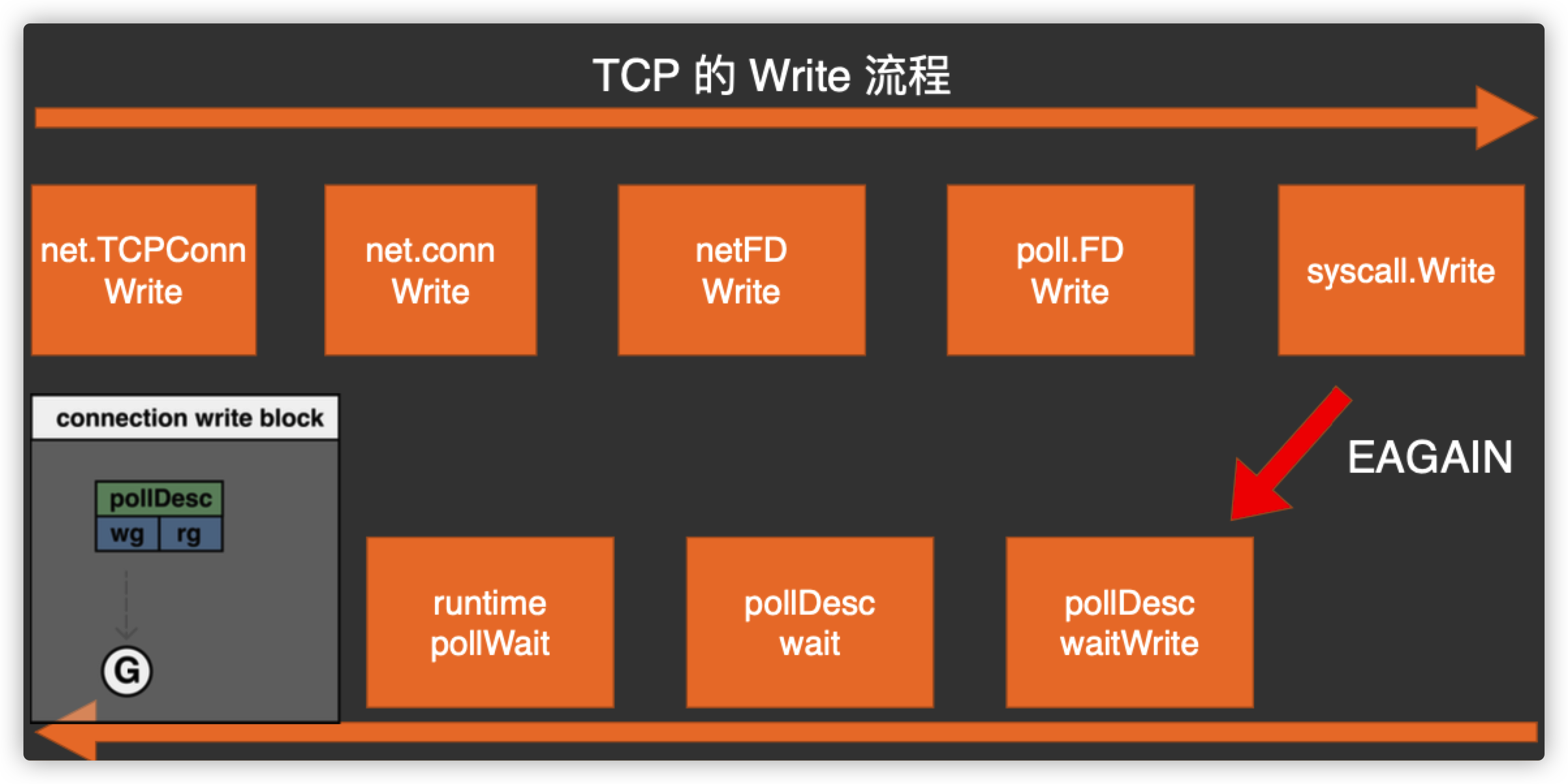

Conn.Write

conn.Write 和 conn.Read 的原理是一致的,它也是通过类似 pollDesc.waitRead 的 pollDesc.waitWrite 来 park 住 goroutine 直至期待的 I/O 事件发生才返回恢复执行。

pollDesc.waitWrite 的内部实现原理和 pollDesc.waitRead 是一样的,都是基于 poll.runtime_pollWait –> runtime.poll_runtime_pollWait.

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

|

// Write implements the Conn Write method.

func (c *conn) Write(b []byte) (int, error) {

if !c.ok() {

return 0, syscall.EINVAL

}

n, err := c.fd.Write(b)

if err != nil {

err = &OpError{Op: "write", Net: c.fd.net, Source: c.fd.laddr, Addr: c.fd.raddr, Err: err}

}

return n, err

}

func (fd *netFD) Write(p []byte) (nn int, err error) {

nn, err = fd.pfd.Write(p)

runtime.KeepAlive(fd)

return nn, wrapSyscallError(writeSyscallName, err)

}

// Write implements io.Writer.

func (fd *FD) Write(p []byte) (int, error) {

// 同一条连接的所有写也是彼此互斥的

if err := fd.writeLock(); err != nil {

return 0, err

}

defer fd.writeUnlock()

if err := fd.pd.prepareWrite(fd.isFile); err != nil {

return 0, err

}

var nn int

for {

max := len(p)

if fd.IsStream && max-nn > maxRW {

max = nn + maxRW

}

n, err := ignoringEINTRIO(syscall.Write, fd.Sysfd, p[nn:max])

if n > 0 {

nn += n

}

if nn == len(p) {

return nn, err

}

if err == syscall.EAGAIN && fd.pd.pollable() {

if err = fd.pd.waitWrite(fd.isFile); err == nil {

continue

}

}

if err != nil {

return nn, err

}

if n == 0 {

return nn, io.ErrUnexpectedEOF

}

}

}

|

总结

所以我们现在可以来从整体的层面来概括 Go 的网络业务 goroutine 是如何被规划调度的了.

- client 连接 server 的时候,listener 通过 accept 调用接收新 connection, accept 调用会把该 connection 的 fd 连带所在的 goroutine 上下文信息封装注册到 epoll 的监听列表里去.

- 每一个新 connection 都启动一个 goroutine 处理,

- 当 goroutine 调用 conn.Read 或者 conn.Write 等需要阻塞等待的函数时,会被 gopark 给封存起来并使之休眠,让 P 去执行本地调度队列里的下一个可执行的 goroutine

- 往后 Go scheduler 会在循环调度的 runtime.schedule() 函数以及 sysmon 监控线程中调用 runtime.nepoll 以获取可运行的 goroutine 列表并通过调用 injectglist 把剩下的 g 放入全局调度队列或者当前 P 本地调度队列去重新执行。

价值

通过前面对源码的分析,我们现在知道 Go netpoller 依托于 runtime scheduler,为开发者提供了一种强大的同步网络编程模式;然而,Go netpoller 存在的意义却远不止于此,Go netpoller I/O 多路复用搭配 Non-blocking I/O 而打造出来的这个原生网络模型,它最大的价值是把网络 I/O 的控制权牢牢掌握在 Go 自己的 runtime 里.

G 在运行过程中如果被阻塞在某个 system call 操作上,那么不光 G 会阻塞,执行该 G 的 M 也会解绑 P,与 G 一起进入 sleep 状态。

如果此时有 idle 的 M,则 P 与其绑定继续执行其他 G;如果没有 idle M,但仍然有其他 G 要去执行,那么就会创建一个新的 M。当阻塞在 system call 上的 G 完成 syscall 调用后,G 会去尝试获取一个可用的 P,如果没有可用的 P,那么 G 会被标记为 _Grunnable 并把它放入全局的 runqueue 中等待调度,之前的那个 sleep 的 M 将再次进入 sleep。

现在清楚为什么 netpoll 为什么一定要使用非阻塞 I/O 了吧?

就是为了避免让操作网络 I/O 的 goroutine 陷入到系统调用从而进入内核态,因为一旦进入内核态,整个程序的控制权就会发生转移(到内核),不再属于用户进程了,那么也就无法借助于 Go 强大的 runtime scheduler 来调度业务程序的并发了.

而有了 netpoll 之后,借助于非阻塞 I/O ,G 就再也不会因为系统调用的读写而 (长时间) 陷入内核态,当 G 被阻塞在某个 network I/O 操作上时,实际上它不是因为陷入内核态被阻塞住了,而是被 Go runtime 调用 gopark 给 park 住了,此时 G 会被放置到某个 wait queue 中,而 M 会尝试运行下一个 _Grunnable 的 G,如果此时没有_Grunnable 的 G 供 M 运行,那么 M 将解绑 P,并进入 sleep 状态。

当 I/O available,在 epoll 的 eventpoll.rdr 中等待的 G 会被放到 eventpoll.rdllist 链表里并通过 netpoll 中的 epoll_wait 系统调用返回放置到全局调度队列或者 P 的本地调度队列,标记为_Grunnable ,等待 P 绑定 M 恢复执行。

缺陷

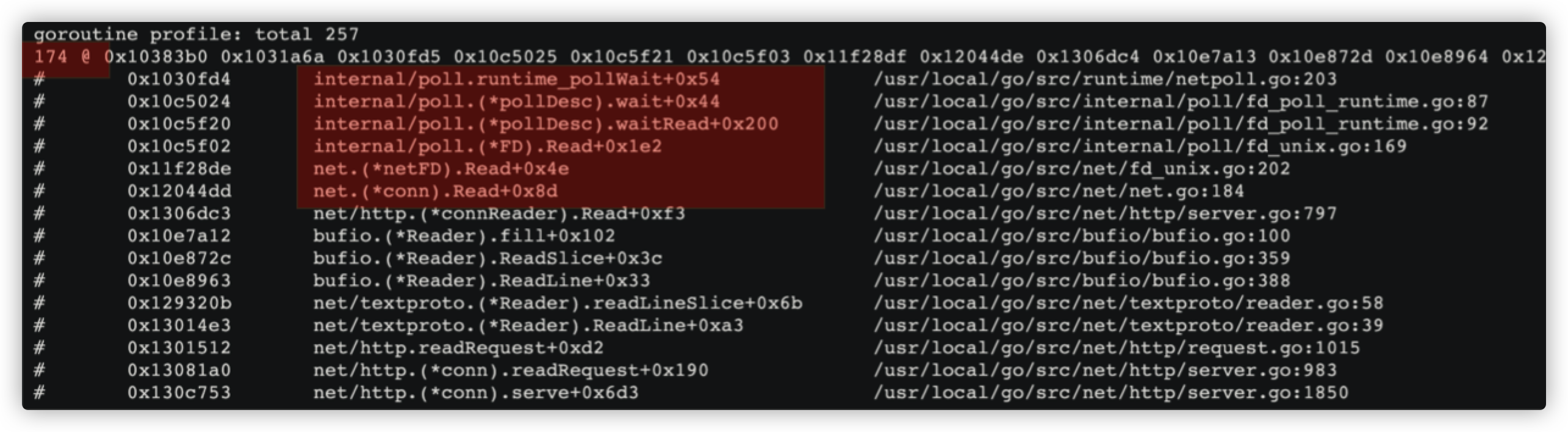

当前我们线上的系统,一般活跃连接较少,大多是类似于:总连接数:5w;活跃连接数:1k 这样的情况,活跃连接在总连接中的比例较低。

不活跃的连接,一般情况下都是阻塞在 conn.Read上,所有阻塞的 goroutine 都会占用 goroutine 的栈空间,以及 Read buffer 的空间

可以认为,这种模式最大的缺陷:那些不活跃的连接要占用太多的资源

参考

6.6 网络轮询器

go netpoller 原生网络模型之源码全面解析